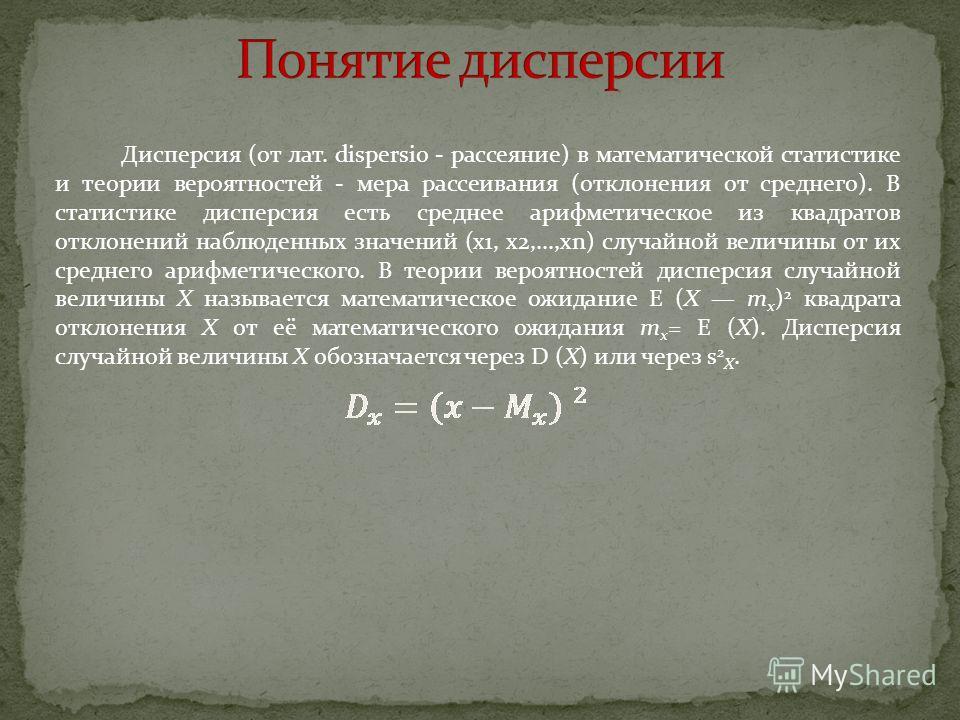

7.4. Формула для вычисления дисперсии

Для вычисления дисперсии часто бывает пользоваться следующей теоремой.

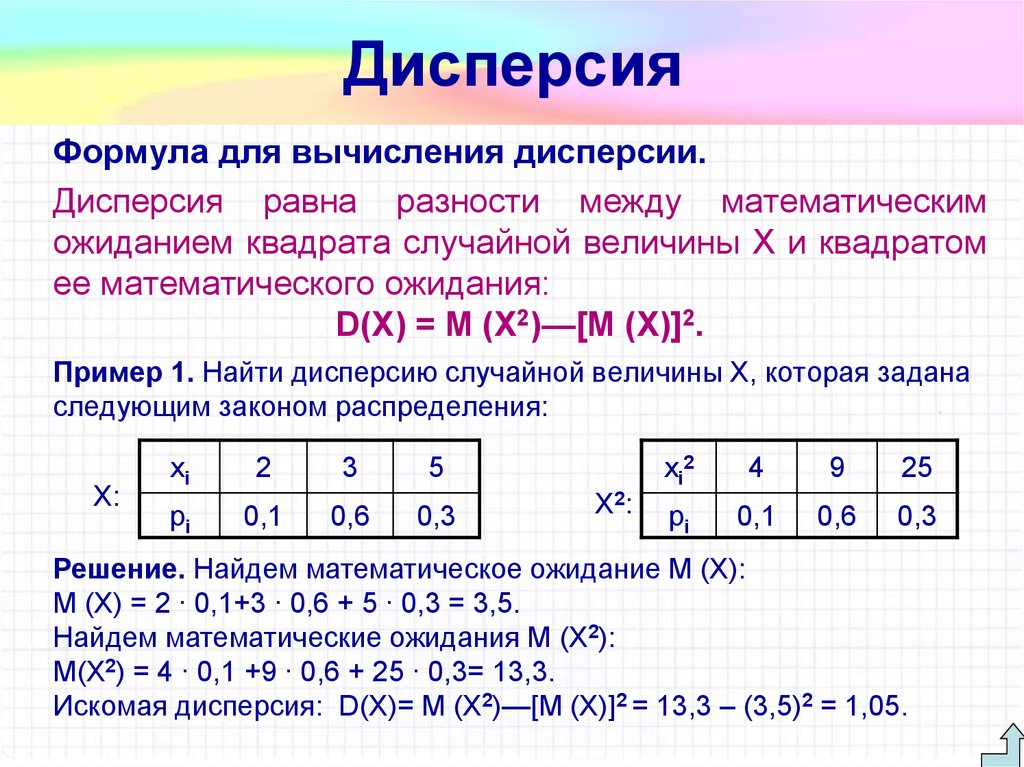

Теорема. Дисперсия равна разности между математическим ожиданием квадрата случайной величины X и квадратом ее математического ожидания:

D(X) = M(X2) – [М(X)]2.

Доказательство. Математическое ожидание М(X) есть постоянная величина, следовательно, 2М(X) и М2(Х) есть также постоянные величины. Приняв это во внимание и пользуясь свойствами математического ожидания (постоянный множитель можно вынести за знак математического ожидания, математическое ожидание суммы равно сумме математических ожиданий слагаемых), упростим формулу, выражающую определение дисперсии:

Итак,

D(X) = M(X2) – [М

Квадратная скобка введена в запись формулы для удобства ее запоминания.

Пример. Найти дисперсию случайной величины X, которая задана следующим законом распределения:

X

2

3

5

р

0,1

0,6

0,3

Решение. Найдем математическое ожидание М(X):

М(X) = 20,1 + 30,6 + 50,3 = 3,5.

Напишем закон распределения случайной величины X2:

X2

4

9

25

р

0,1

0,6

0,3

Найдем математические ожидания M(X2):

M(X2)

= 40,1

+ 90,6

+ 250,3

= 13,3.

Искомая дисперсия

D(X) = M(X2) – [М(X

Замечание. Казалось бы, если X и Y имеют одинаковые возможные значения и

одно и то же математическое ожидание,

то и дисперсии этих величин равны (ведь

возможные значения обеих величин

одинаково рассеяны вокруг своих

математических ожиданий!). Однако в

общем случае это не так. Дело в том, что

одинаковые возможные значения

рассматриваемых величин имеют, вообще

говоря, различные вероятности, а величина

дисперсии определяется не только самими

возможными значениями, но и их

вероятностями.

Например, если вероятности «далеких»

от математического ожидания возможных

значений Х больше, чем вероятности этих же значений Y,

и вероятности «близких» значений X меньше, чем вероятности тех же значений Y,

то, очевидно, дисперсия X больше дисперсии Y.

Приведем иллюстрирующий пример.

Пример. Сравнить дисперсии случайных величин, заданных законами распределения:

X | — 1 | 1 | 2 | 3 | Y | — 1 | 1 | 2 | 3 | |

р | 0,48 | 0,01 | 0,09 | 0,42 | р | 0,51 | 0,25 | 0,05 |

Решение. Легко убедиться, что

Легко убедиться, что

М(Х) = М(Y) = 0,97; D(X) 3,69, D(Y) 1,21.

Таким образом, возможные значения и математические ожидания X и Y одинаковы, а дисперсии различны, причем D(X) > D(Y). Этот результат можно было предвидеть без вычислений, глядя лишь на законы распределений.

Свойство 1. Дисперсия постоянной величины С равна нулю:

D(С) = 0.

Доказательство. По определению дисперсии,

D(С) = M{[C – M(C)]2}.

Пользуясь первым свойством математического ожидания (математическое ожидание постоянной равно самой постоянной), получимD(С) = M[(C – C)2] = M(0) = 0.

Итак,

D(С)

= 0.

Свойство становится ясным, если учесть, что постоянная величина сохраняет одно и то же значение и рассеяния, конечно, не имеет.

Свойство 2. Постоянный множитель можно выносить за знак дисперсии, возводя его в квадрат:

D(СX) = C2D(X).

Доказательство. По определению дисперсии имеем

D(СX) = M{[CX – M(CX)]2

Пользуясь вторым свойством математического ожидания (постоянный множитель можно выносить за знак математического ожидания), получим

D(СX)

= M{[CX – CM(X)]2}

= M{C2[X – M(X)]2}

= C2M{[X – M(X)]2}

= C2D(X).

Итак,

D(СX) = C2D(X).

Свойство становится ясным, если принять во внимание, что при |С| > 1 величина СХ имеет возможные значения (по абсолютной величине), большие, чем величина X. Отсюда следует, что эти значения рассеяны вокруг математического ожидания М(СХ) больше, чем возможные значения X вокруг М(Х), т.е. D(СХ) > D(X). Напротив, если 0 < |С| < 1, то D(СХ) < D(X).

Свойство 3. Дисперсия суммы двух независимых случайных величин равна сумме дисперсий этих величин:

D(X + Y) = D(X) + D(Y)

Доказательство. По формуле для вычисления дисперсии имеем

D(X + Y)

= М[(X + Y)2] – [М(X + Y)]2.

Раскрыв скобки и пользуясь свойствами математического ожидания суммы нескольких величин и произведения двух независимых случайных величин, получим

Итак,

D(X + Y) = D(X) + D(Y).

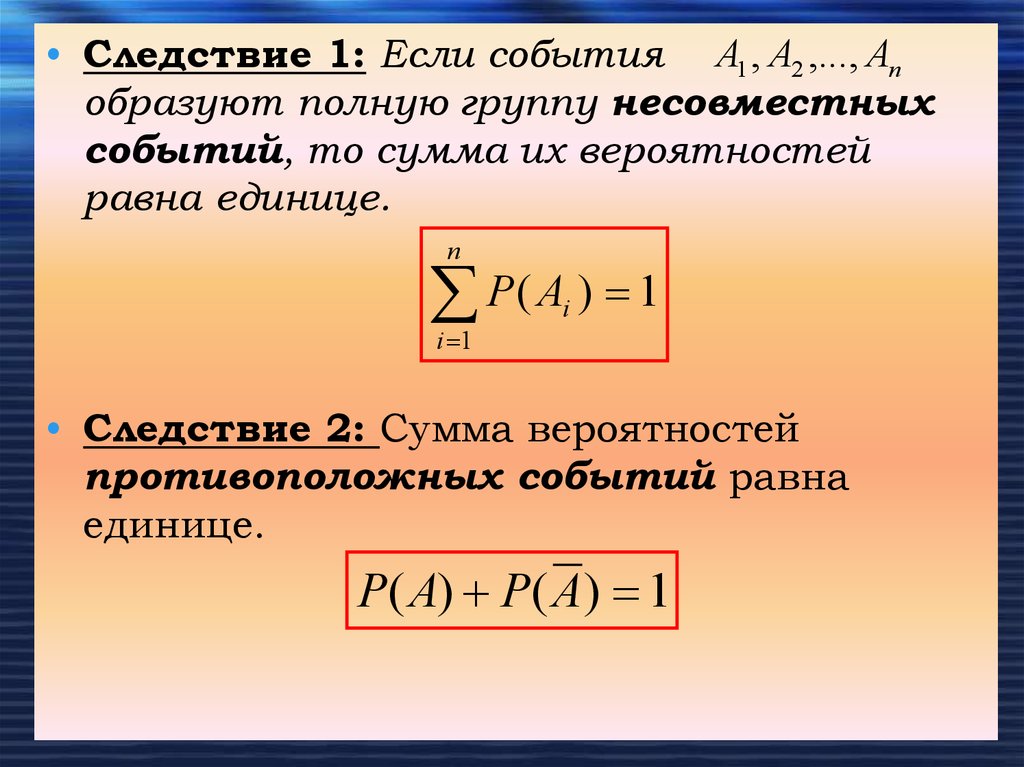

Следствие 1. Дисперсия суммы нескольких взаимно независимых случайных величин равна сумме дисперсий этих величин.

Например, для трех слагаемых имеем

.

Для произвольного числа слагаемых доказательство проводится методом математической индукции.

Следствие 2. Дисперсия суммы постоянной величины и случайной равна дисперсии случайной величины:

D(С + Y) = D(X).

Доказательство. Величины С и X независимы, поэтому, по третьему свойству,

D(C + X)

= D(С)+ D(X).

В силу первого свойства D(С) = 0. Следовательно,

D(С + Y) = D(X).

Свойство становится понятным, если учесть, что величины X и Х + С отличаются лишь началом отсчетам, значит, рассеяны вокруг своих математических ожиданий одинаково.

Свойство 4. Дисперсия разности двух независимых случайных величин равна сумме их дисперсий:

D(X – Y) = D(X) + D(Y).

Доказательство. В силу третьего свойства

D(X – Y) = D(X) + D(–Y).

По второму свойству,

D(X – Y) = D(X)

или

D(X – Y)

= D(X) + D(Y).

Теория вероятностей. Семинары | Открытые видеолекции учебных курсов МГУ

Семинары по курсу теории вероятностей. Курс «Теория вероятностей» читается на механико-математическом факультете МГУ в 4 семестре. Он предваряет курсы «Теория случайных процессов» и «Математическая статистика» и содержит базовые вопросы теории вероятностей — от аксиоматики Колмогорова до закона больших чисел и центральной предельной теоремы.

Список всех тем лекций

Семинар 1. Вероятностное пространство.

Пример построения вероятностного пространства — два множества (с возвращением)

Задачи о шарах

Задача №1

Задача №2

Задача №3

Задача №4

Интерпретация исхода

Семинар 2. Условные вероятности.

Задача о шарах

Определение условной вероятности

Формула полной вероятности

Пример (о монетке)

Формула Байеса

Пример

Независимость

Примеры

Схема независимых испытаний

Схема Бернулли

Семинар 3. Случайные величины.

Случайная величина (понятие и пример)

Распределение случайной величины

Комментарий к задачам (студенты решали самостоятельно)

Сигма-алгебра

Совместное распределение

Независимость случайных величин

Примеры

Формула свёртки

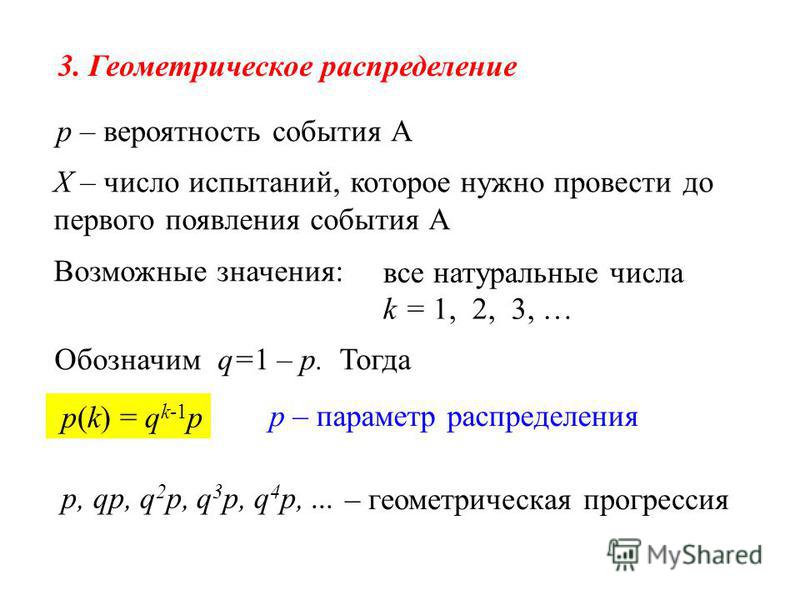

Основные распределения

Семинар 4. Математическое ожидание.

Математическое ожидание.

Математическое ожидание

Примеры

Приём подсчёта суммы

Свойства математического ожидания

Дисперсия

Свойства математического ожидания (продолжение)

Пример

Семинар 5. Производящие функции.

Производящая функция (определение)

Пример

Разбор задач, которые были даны для самостоятельного решения

Свойства производящих функций

Производящие функции векторов

Пример

Семинар 6. Общее вероятностное пространство.

Вероятностное пространство

Пересечение множеств

Разбор задачи, которая была дана для самостоятельного решения

Свойства пересечения множеств

Теорема Каратеодори

Борелевская алгебра

Пример

Семинар 7. Функция распределения.

Функция распределения.

Случайная величина (определение)

Распределение случайных величин

Функция распределения (пример)

Функция распределения (пример)

Пример (непрерывный случай)

Свойства функции распределения

Дискретное распределение

Абсолютно непрерывный случай

Примеры

Случайные векторы

Формула свёртки

Семинар 8. Математическое ожидание.

Построение интеграла Лебега

Интеграл Римана-Стилтьеса

Разбор задачи, которая была дана для самостоятельного решения

Интегрирование по частям

Свойства математического ожидания

Теорема о монотонной сходимости

Теорема о мажорируемой сходимости

Свойства дисперсии

Семинар 9. Случайные векторы.

Случайные векторы.

Случайные векторы (определение)

Задача (посчитать функцию распределения)

Разбор задачи, которая была дана для самостоятельного решения

Примеры

Плотность вероятности случайного вектора.

Математическое ожидание вектора

Семинар 10. Характеристические функции.

Комплекснозначные случайные величины

Характеристическая функция случайной величины

Свойства характеристических функций

Пример

Теорема единственности

Теорема непрерывности

Формулы обращения

Семинар 11. Сходимости.

Сходимость почти наверное

Лемма (о сходимости почти наверное)

Определение сходимости почти наверное в терминах распределения

Критерий Коши сходимости почти наверное

Сходимость по вероятности

Критерий Коши сходимости по вероятности

Лемма (о сходимости по вероятности)

Сходимость в среднем порядка Р

Критерий Коши сходимости в среднем порядка Р

Сходимость по распределению

Лемма (о сходимости по распределению)

Пример

Семинар 12. Закон больших чисел (ЗБЧ). Центральная предельная теорема (ЦПТ).

Схема Бернулли

Теорема Муавра — Лапласа

Закон больших чисел (определение)

Теорема (закон больших чисел Чебышева)

Теорема (закон больших чисел Хинчина)

Теорема (усиленный закон больших чисел Колмогорова)

Центральная предельная теорема (ЦПТ)

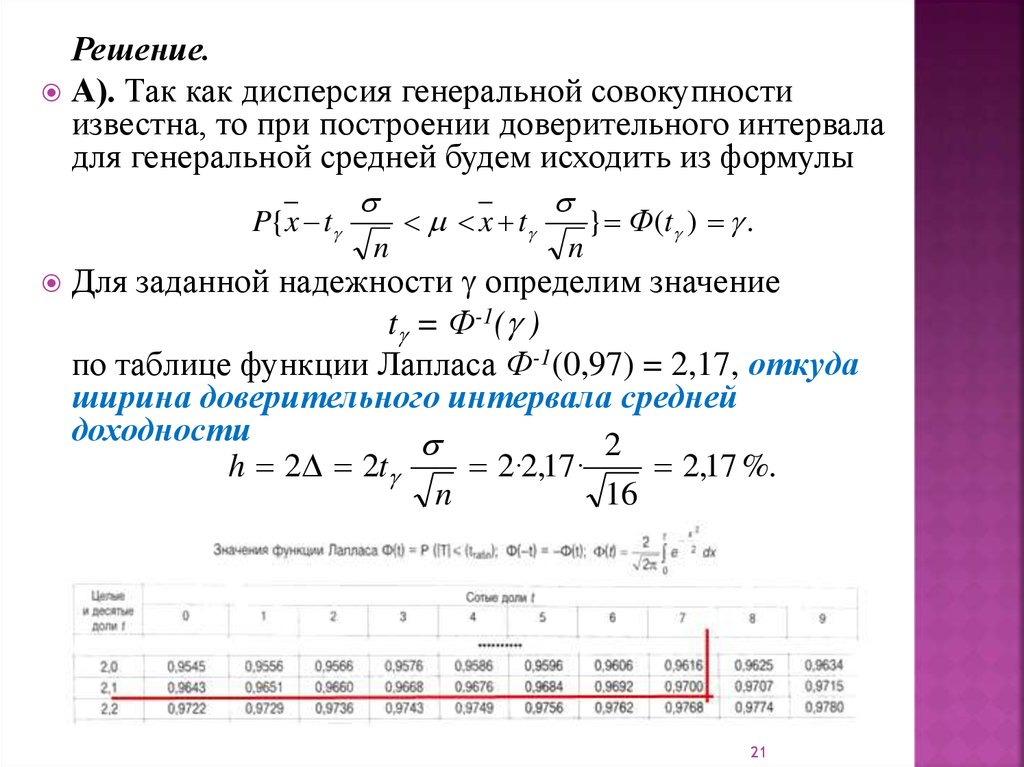

Случайные величины: математическое ожидание и дисперсия

Вероятность

Анализ данных, том 1

- 0

$ \def\P{\mathsf{\sf P}} \ def \ E {\ mathsf {\ sf E}} \def\Var{\mathsf{\sf Var}} \def\Cov{\mathsf{\sf Cov}} \def\std{\mathsf{\sf std}} \def\Cor{\mathsf{\sf Cor}} \def\R{\mathbb{R}} \ деф \ с {\, | \,} \def\bb{\boldsymbol} \def\diag{\mathsf{\sf diag}} $

2.

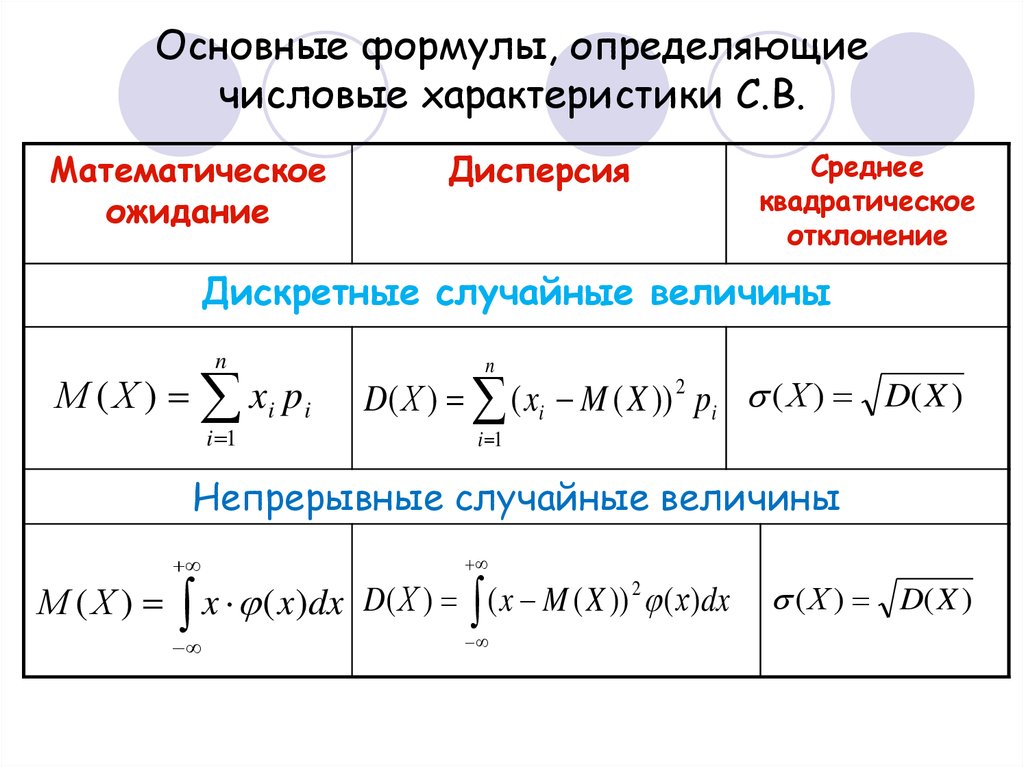

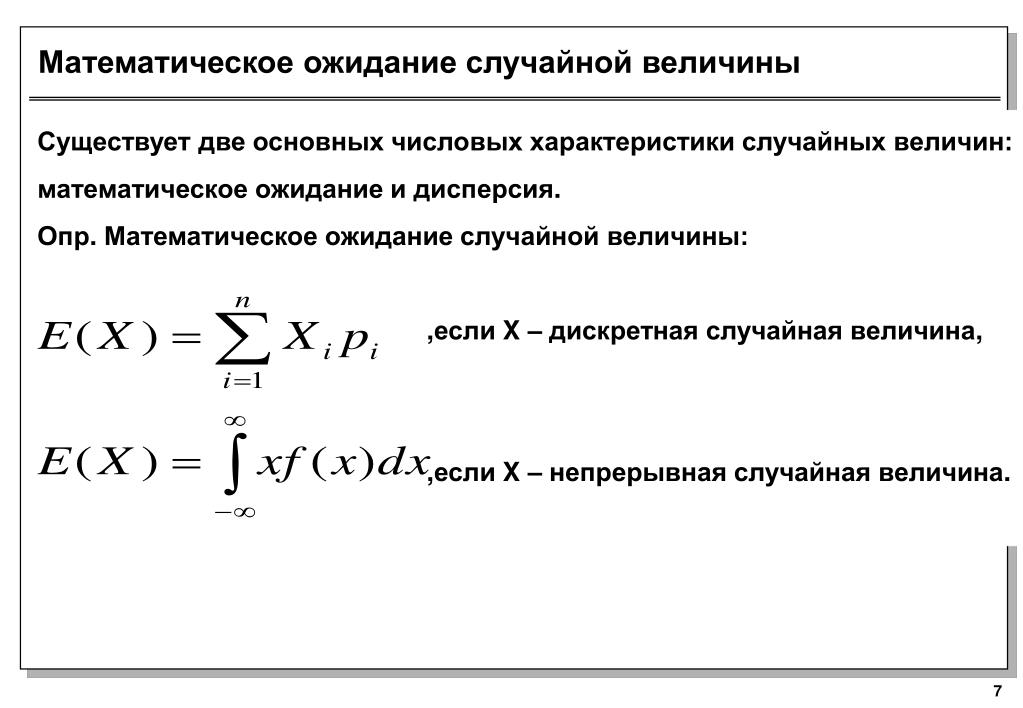

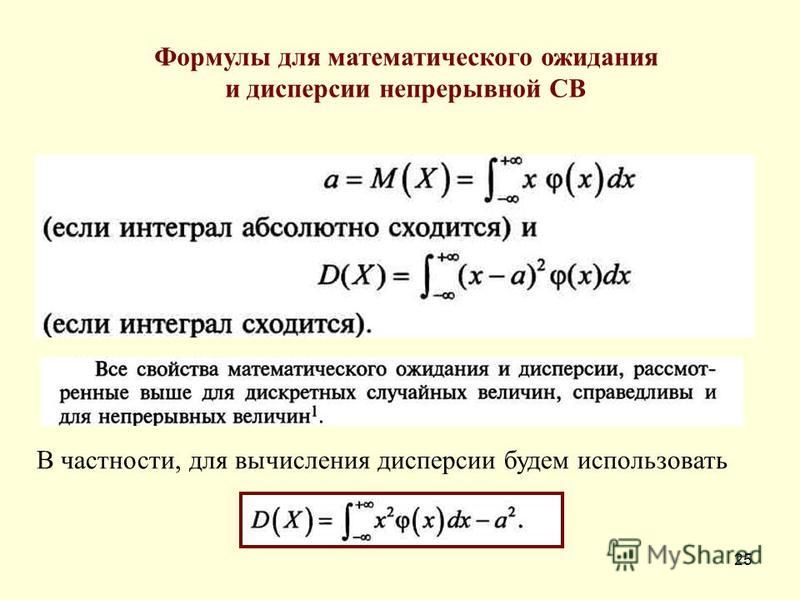

3. Математическое ожидание и дисперсия

3. Математическое ожидание и дисперсияДля случайной величины мы часто вычисляем математическое ожидание и дисперсию — два важных сводных статистических показателя. Ожидание описывает среднее значение, а дисперсия описывает разброс (количество изменчивости) вокруг ожидания. 9{\infty} x \, f_X(x)\, dx & X \text{является непрерывным RV} \конец{случаи}, \конец{выравнивание*} при условии, что сумма или интеграл существуют.

Пример 2.3.1. Ожидание RV, выражающее результат броска честной кости.

является

\[ \E(X)=1 p_X(1)+\cdots 6 p_X(6)=\frac{1}{6}(1+\cdots+6)=21/6=3,5.\]

Интуитивно ожидание дает долгосрочное среднее значение многих бросков костей.

\begin{align*}\text{average}=&\frac{1\cdot(\text{#-из

раз мы получаем 1})+\cdots+6\cdot(\text{количество раз-мы-получаем 6})}{k}\\

&=1\cdot\,\text{частота получения 1}+\cdots+6\cdot\,\text{частота получения 6}\\ &\to \E(X),

\конец{выравнивание*}

как $n\to\infty$, предполагая, что частота получения $i$ в долгосрочной перспективе сходится к $p(X=i)$. Мы подробно остановимся на этой теме в разделе 8.6. 9{\infty} g(x) f_X(x)dx & X \text{ является непрерывным RV}\end{cases}. \label{eq:RV:expFun}

\end{align}

Мы подробно остановимся на этой теме в разделе 8.6. 9{\infty} g(x) f_X(x)dx & X \text{ является непрерывным RV}\end{cases}. \label{eq:RV:expFun}

\end{align}

Доказательство. Первое равенство следует из определения, а второе равенство следует из того, что значение $g(x)$ возникает при появлении $x$, что происходит с вероятностью $p_X(x)$ в дискретном случае или с плотностью $f_X(x)$ в случае непрерывный случай.

Предложение 2.3.2. Для любых констант $a,b\in\mathbb{R}$ математическое ожидание $Y=aX+b$ равно \[ \E(aX+b)=a \E(X) + b.\]

Доказательство. Используя предыдущее предложение, имеем \начать{выравнивать*} \E(aX+b)&=\sum_x (ax+b)p_X(x) = a \sum_x x p_X(x)+b \sum_x p_X(x) \\ &= a\E(x)+b \cdot 1 \конец{выравнивание*} для дискретного РВ. В случае непрерывного СВ заменим суммирование интегралом.

В приведенном выше предложении конкретно говорится, что \begin{align*}\E(X+b)&=\E(X)+b, \text{and}\\ \E(aX)&=a\E(X).\end{align*}

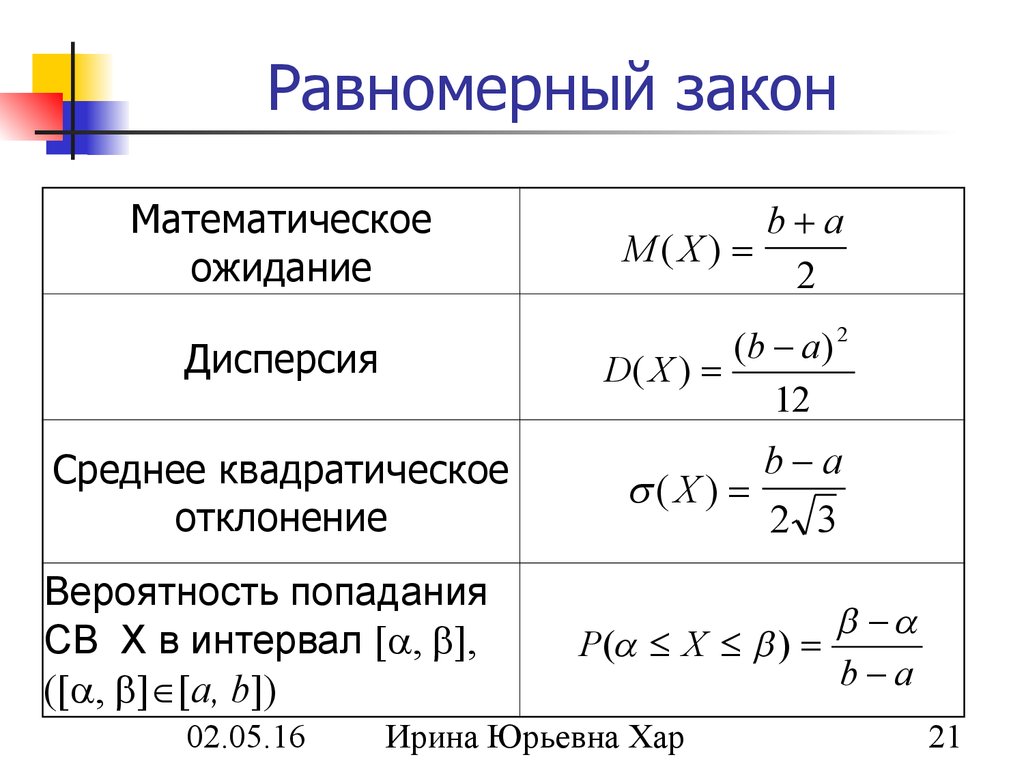

Дисперсия измеряет величину изменчивости RV $X$ вокруг $\E(X)$. 2}{12}

\конец{выравнивание*}

растет с длиной интервала $|b-a|$, подтверждая нашу интуицию о том, что узкие PDF и широкие PDF демонстрируют низкую и широкую дисперсию соответственно. 92=Е(0)=0.

\конец{выравнивание*}

2}{12}

\конец{выравнивание*}

растет с длиной интервала $|b-a|$, подтверждая нашу интуицию о том, что узкие PDF и широкие PDF демонстрируют низкую и широкую дисперсию соответственно. 92=Е(0)=0.

\конец{выравнивание*}

8.4 — Разница X

Рассмотрим две функции массы вероятности. Первый:

| х | 3 | 4 | 5 |

|---|---|---|---|

| ф(х) | 0,3 | 0,4 | 0,3 |

А, второй:

| у | 1 | 2 | 6 | 8 |

|---|---|---|---|---|

| ф(у) | 0,4 | 0,1 | 0,3 | 0,2 |

Это простое вычисление показывает, что среднее значение \(X\) и среднее значение \(Y\) совпадают:

\(\mu_X=E(X) = 3(0,3)+ 4(0,4)+5(0,3)=4\)

\(\mu_Y=E(Y)=1(0,4)+2(0,1)+6(0,3)+8(0,2)=4\)

Давайте нарисуем рисунок, иллюстрирующий две п. 2\), математическое ожидание \(u(X)\): 92}\)

2\), математическое ожидание \(u(X)\): 92}\)

Хотя большинство учащихся понимают, что \(\mu=E(X)\) в некотором смысле является мерой середины распределения \(X\), гораздо труднее получить чувство значения дисперсии и стандартного отклонения. Следующий пример (надеюсь) иллюстрирует, как дисперсия и стандартное отклонение количественно определяют разброс или дисперсию значений в поддержке \(S\).

Вернемся к функциям массы вероятности из предыдущего примера. Первый:

| х | 3 | 4 | 5 |

|---|---|---|---|

| ф(х) | 0,3 | 0,4 | 0,3 |

А, второй:

| у | 1 | 2 | 6 | 8 | |||||||

|---|---|---|---|---|---|---|---|---|---|---|---|

| ф(у) | 0,4 | 0,1 | 0,3 92(0.2)=8.4\) И, следовательно, стандартное отклонение \(Y\) равно: \(\sigma_Y=\sqrt{8.4}=2.9\) Как видите, ожидаемое вариация случайной величины \(Y\), определяемая количественно ее дисперсией и стандартным отклонением, намного больше, чем ожидаемая вариация случайной величины \(X\). Как вы могли заметить, формула для дисперсии дискретной случайной величины может быть довольно громоздкой в использовании. К счастью, есть более простая в использовании альтернативная формула. 92\) ДоказательствоИспользуйте альтернативную формулу для проверки того, что дисперсия случайной величины \(X\) со следующей функцией массы вероятности:

равно 0,6, как мы рассчитали ранее. Раствор92_X\\ \sigma_Y &=& |a|\sigma_X \end{array}Доказательство |

Учитывая p.m.f. двух случайных величин, этот результат не должен удивлять.

Учитывая p.m.f. двух случайных величин, этот результат не должен удивлять.