Выборочная несмещенная дисперсия — statanaliz.info

Приветствую посетителей блога statanaliz.info. В данной статье рассмотрим, что такое «выборочная несмещенная дисперсия».

Тема не нова, так как с таким показателями как размах значений, среднее линейное отклонение, дисперсия, среднеквадратичное (стандартное) отклонение, коэффициент вариации мы уже знакомы.

Понятие о сплошном и выборочном наблюдении

С точки зрения охвата объекта исследования, статистический анализ можно разделить на два вида: сплошной и выборочный. Сплошной статанализ предполагает изучение генеральной совокупности данных, то есть всего явления во всем его многообразии без распространения выводов на другие элементы, не входящие в анализируемую совокупность. Из названия данного типа явствует, что наблюдению подвергаются тотально все элементы. Результат анализа распространяется на всю генеральную совокупность без каких-либо допущений и поправок на ошибку. Данный тип статистического исследования является наиболее полным и точным, так как дополнительные знания почерпнуть уже неоткуда – информация собрана со всех элементов объекта исследования. Это бесспорный плюс.

Это бесспорный плюс.

Отличным примером сплошного наблюдения является перепись населения. «Всесоюзная перепись населения» — красиво звучало! Кстати, советская статистика, как и наука в целом, была одной из самых лучших в мире. Денег на проведение сплошных обследований не жалели, так как при СССР статистика выполняла свою прямую функцию – исследовала реальность, без чего невозможно было строить «светлое будущее». При этом советские ученые-статистики справедливо критиковали буржуазную статистику за то, что те скрывают от народа реальное положение дел и используют статистику для промывки мозгов. Об этом, кстати, писали и сами буржуи. Более практичный пример сплошного наблюдения – опрос жителей многоэтажного дома на предмет заваривания мусоропровода. Опрашиваются все, результат дает вполне однозначный ответ об отношении жителей к мусоропроводу. Ошибки в выводах маловероятны.

Как бы там ни было, у сплошного наблюдения есть отрицательное качество: на организацию и проведение исследования могут потребоваться значительные ресурсы. Одно дело взять пробу из партии товаров, другое – проверять всю партию. Одно дело опросить тысячу прохожих на улице, совсем другое – организовать перепись населения.

Одно дело взять пробу из партии товаров, другое – проверять всю партию. Одно дело опросить тысячу прохожих на улице, совсем другое – организовать перепись населения.

В противовес сплошному придумали выборочное наблюдение. Название метода точно отражает его суть: из генеральной совокупности отбирается и анализируется только часть данных, а выводы распространяют на всю генеральную совокупность. Отбор данных происходит таким образом, чтобы выборка была репрезентативной, то есть, сохранила внутреннюю структуру и закономерности генеральной совокупности. Если это условие не соблюдено, то дальнейший анализ во многом теряет смысл.

Сам анализ выборочных данных происходит так же, как и при сплошном наблюдении (рассчитываются различные показатели, делаются прогнозы и т.д.), только с поправкой на ошибку. Это значит, что рассчитывая тот или иной показатель, мы понимаем, что при повторной выборке его значение будет другим. К примеру, провели опрос общественного мнения. Опрос показал, что за кандидата N желают проголосовать 60% опрошенных. Если провести еще один такой же опрос, даже в том же месте, то результат будет отличаться. То есть, взяв первое значение 60%, следует понимать, что с той или иной вероятностью оно могло быть, скажем, и 58%, и 62%. Точность и разброс выборочных показателей зависят от характера данных и их количества.

Опрос показал, что за кандидата N желают проголосовать 60% опрошенных. Если провести еще один такой же опрос, даже в том же месте, то результат будет отличаться. То есть, взяв первое значение 60%, следует понимать, что с той или иной вероятностью оно могло быть, скажем, и 58%, и 62%. Точность и разброс выборочных показателей зависят от характера данных и их количества.

У выборочного наблюдения есть один существенный плюс и один минус, однако по сравнению со сплошным наблюдением крайности меняются местами. Плюс заключается в том, что для проведения выборочного обследования требуется гораздо меньше ресурсов. Минус – в том, что выборочное наблюдение всегда ошибочно. Поэтому основная задача проведения выборочного наблюдения – добиться максимальной точности при приемлемых затратах на его проведение.

Выборочная несмещенная дисперсия

И вот, стало быть, дисперсия. Дисперсия, как и доля или средняя арифметическая, также меняет свое значение от выборки к выборке, но здесь есть интересная особенность. Дисперсия ведь рассчитывается от средней величины, а она в свою очередь, тоже рассчитывается по выборке, то есть является ошибочной. Как же это обстоятельство влияет на саму дисперсию?

Дисперсия ведь рассчитывается от средней величины, а она в свою очередь, тоже рассчитывается по выборке, то есть является ошибочной. Как же это обстоятельство влияет на саму дисперсию?

Если бы мы знали истинную среднюю величину (по генеральной совокупности), то ошибка дисперсии была бы связана только с нерепрезентативностью, то есть с тем, что данные в выборке оказались бы ближе или дальше от средней, чем в целом по генеральной совокупности. При этом при многократном повторении данные стремились бы к своему реальному расположению относительно средней.

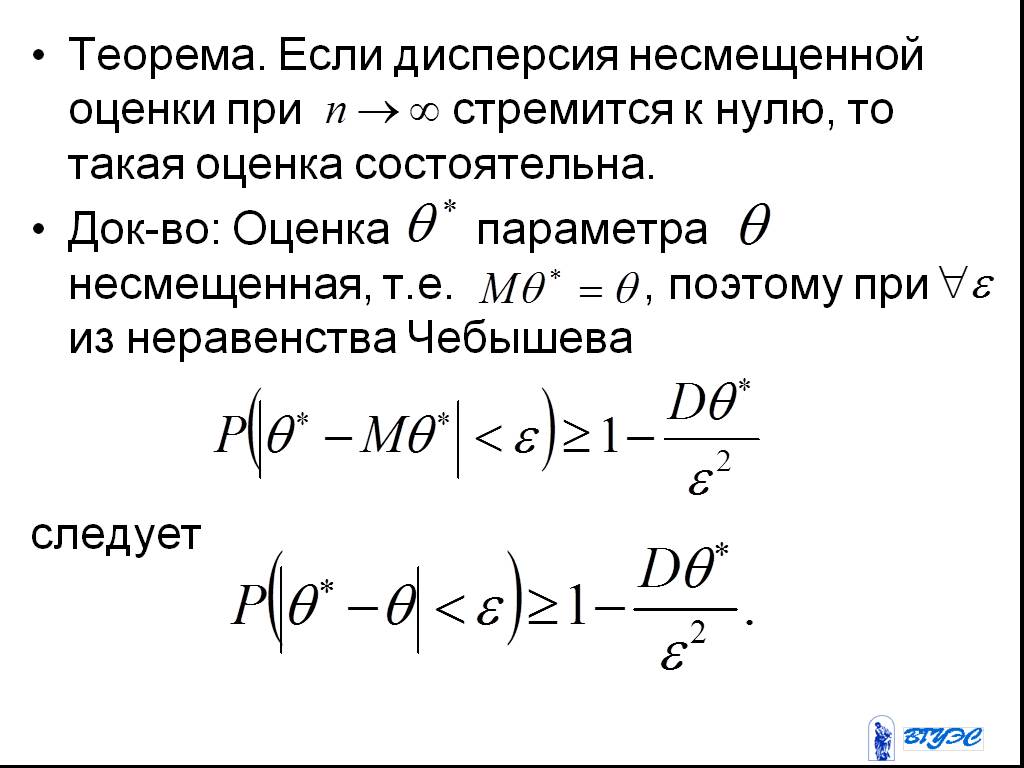

Выборочный показатель, который при многократном повторении выборки стремится к своему теоретическому значению, называется несмещенной оценкой. Почему оценкой? Потому что мы не знаем реальное значение показателя (по генеральной совокупности), и с помощью выборочного наблюдения пытаемся его оценить. Оценка показателя – это есть его характеристика, рассчитанная по выборке.

Теперь смотрим внимательно на выборочную среднюю. Выборочная средняя – это несмещенная оценка математического ожидания, так как средняя из выборочных средних стремится к своему теоретическому значению по генеральной совокупности. Где она расположена? Правильно, в центре выборки! Средняя всегда находится в центре значений, по которым рассчитана – на то она и средняя. А раз выборочная средняя находится в центре выборки, то из этого следует, что сумма квадратов расстояний от каждого значения выборки до выборочной средней всегда меньше, чем до любой другой точки, в том числе и до генеральной средней. Это ключевой момент. А раз так, то дисперсия в каждой выборке будет занижена. Средняя из заниженных дисперсий также даст заниженное значение. То есть при многократном повторении эксперимента выборочная дисперсия не будет стремиться к своему истинному значению (как выборочная средняя), а будет смещена относительно истинного значения по генеральной совокупности.

Выборочная средняя – это несмещенная оценка математического ожидания, так как средняя из выборочных средних стремится к своему теоретическому значению по генеральной совокупности. Где она расположена? Правильно, в центре выборки! Средняя всегда находится в центре значений, по которым рассчитана – на то она и средняя. А раз выборочная средняя находится в центре выборки, то из этого следует, что сумма квадратов расстояний от каждого значения выборки до выборочной средней всегда меньше, чем до любой другой точки, в том числе и до генеральной средней. Это ключевой момент. А раз так, то дисперсия в каждой выборке будет занижена. Средняя из заниженных дисперсий также даст заниженное значение. То есть при многократном повторении эксперимента выборочная дисперсия не будет стремиться к своему истинному значению (как выборочная средняя), а будет смещена относительно истинного значения по генеральной совокупности.

Отклонение выборочной средней от генеральной показано на рисунке.

Несмещенность оценки – одна из важных характеристик статистического показателя. Смещенная оценка показателя заранее говорит о тенденции к ошибке. Поэтому показатели стараются оценивать таким образом, чтобы их оценки были несмещенными (как у средней арифметической). Чтобы решить проблему смещенности выборочной дисперсии, в ее расчет вносят корректировку – умножают на n/(n-1), либо сразу при расчете в знаменатель ставят не n, а n-1. Получается так.

Смещенная оценка показателя заранее говорит о тенденции к ошибке. Поэтому показатели стараются оценивать таким образом, чтобы их оценки были несмещенными (как у средней арифметической). Чтобы решить проблему смещенности выборочной дисперсии, в ее расчет вносят корректировку – умножают на n/(n-1), либо сразу при расчете в знаменатель ставят не n, а n-1. Получается так.

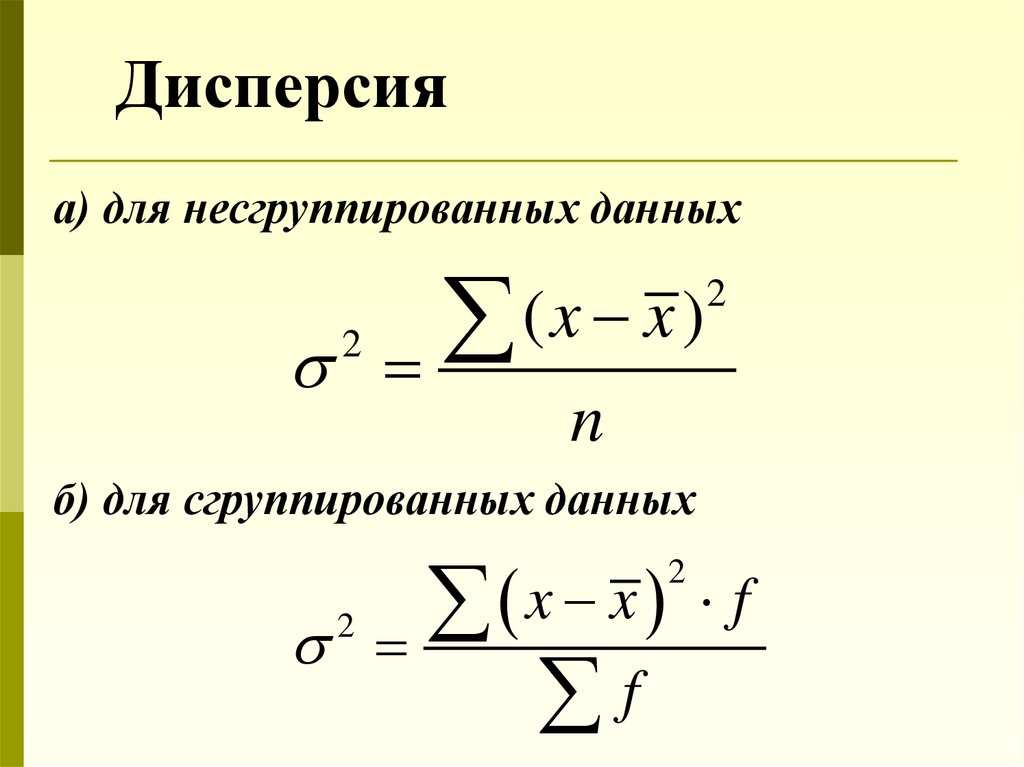

Выборочная смещенная дисперсия:

Выборочная несмещенная дисперсия:

Под выборочной дисперсией понимают, как правило, именно несмещенный вариант.

Теперь посмотрим на практическую сторону отличия смещенной и несмещенной дисперсии. Соотношение между выборочной и генеральной дисперсией составляет n/n-1. Несложно догадаться, что с ростом n (объема выборки) данное выражение стремится к 1, то есть разница между значениями выборочной и генеральной дисперсиями уменьшается.

Так, в выборке из 11 наблюдений относительная разница составляет 11/10 = 10%. При 21 наблюдениях, отличие сокращается до 5%, при 31 наблюдении – до 3,3%, при 51 – до 2%, при 101 – до 1%. Короче, при достаточно большой выборке данных (50 и выше наблюдений) относительная разница между смещенной и несмещенной дисперсией практически исчезает. Оценка параметра, когда с ростом выборки его отклонение от теоретического значения уменьшается, называется асимптотически несмещенной оценкой.

При 21 наблюдениях, отличие сокращается до 5%, при 31 наблюдении – до 3,3%, при 51 – до 2%, при 101 – до 1%. Короче, при достаточно большой выборке данных (50 и выше наблюдений) относительная разница между смещенной и несмещенной дисперсией практически исчезает. Оценка параметра, когда с ростом выборки его отклонение от теоретического значения уменьшается, называется асимптотически несмещенной оценкой.

При переходе к среднеквадратичном отклонению по выборке (корень из выборочной дисперсии) разница становится еще меньше.

Таким образом, эффект смещенной дисперсии проявляется в небольших выборках. В больших выборках можно использовать генеральную дисперсию, что как бы не усложняет и не упрощает жизнь. Вручную сейчас никто не считает. Все легко посчитать в Excel. Но понимать различие в терминологии и в сути показателей все же следует.

Из данной статьи неплохо бы усвоить следующее.

1. Формула генеральной дисперсии в выборке дает смещенную оценку.

2. В знаменателе несмещенной оценки n-1 вместо n.

3. При большом объеме выборки (от 100 наблюдений) разница между смещенной и несмещенной дисперсиями практически исчезает.

4. Стандартное отклонение по выборке – это корень из выборочной дисперсии.

До новых встреч на блоге statanaliz.info.

Поделиться в социальных сетях:

Несмещенная оценка дисперсии — исправленная выборочная дисперсия. Решение задач и контрольных работ теории вероятностей и статистике онлайн

Краткая теория

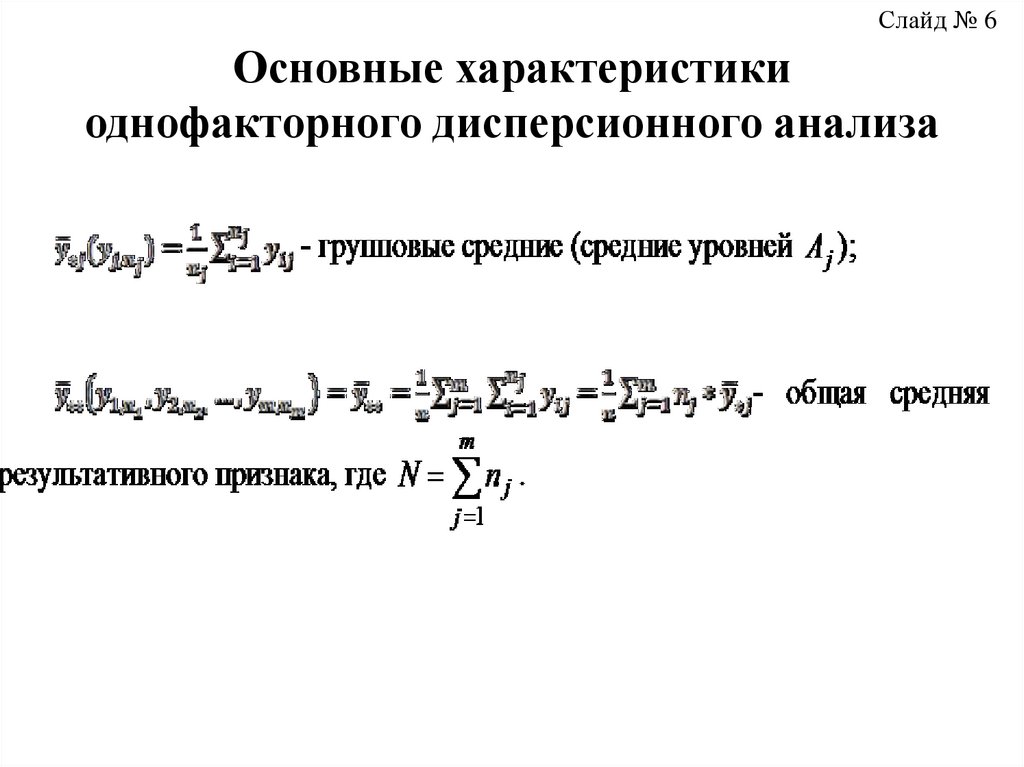

Пусть из генеральной совокупности в результате независимых наблюдений над количественным признаком извлечена повторная выборка объема :

| Значения признака | … | |||

| Частоты | … |

При этом

Требуется по данным выборки оценить (приближенно найти) неизвестную

генеральную дисперсию

. Если в качестве оценки генеральной дисперсии принять выборочную дисперсию, то

эта оценка будет приводить в систематическим ошибкам, давая заниженное значение

генеральной дисперсии. Объясняется это тем, что, как можно доказать, выборочная

дисперсия является смещенной оценкой

,

другими словами, математическое ожидание выборочной дисперсии не равно

оцениваемой генеральной дисперсии, а равно:

Если в качестве оценки генеральной дисперсии принять выборочную дисперсию, то

эта оценка будет приводить в систематическим ошибкам, давая заниженное значение

генеральной дисперсии. Объясняется это тем, что, как можно доказать, выборочная

дисперсия является смещенной оценкой

,

другими словами, математическое ожидание выборочной дисперсии не равно

оцениваемой генеральной дисперсии, а равно:

Легко «исправить» выборочную дисперсию так, чтобы ее математическое ожидание было равно генеральной дисперсии. Достаточно для этого умножить на дробь . Сделав это, получим исправленную дисперсию, которую обычно обозначают через :

Исправленная дисперсия является, конечно, несмещенной оценкой генеральной дисперсии. Действительно:

Итак, в качестве оценки генеральной дисперсии принимают исправленную дисперсию:

Для оценки среднего квадратического отклонения генеральной совокупности используют исправленное среднее квадратическое отклонение, которое равно квадратному корню из исправленной дисперсии:

При достаточно больших значениях

объема выборки выборочная и исправленная

дисперсия отличаются мало. На практике используются исправленной дисперсией,

если примерно

.

На практике используются исправленной дисперсией,

если примерно

.

Пример решения задачи

Найти несмещенную выборочную дисперсию на основании данного распределения выборки.

| 16 | 20 | 22 | 30 | |

| 14 | 26 | 17 | 3 |

Решение

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

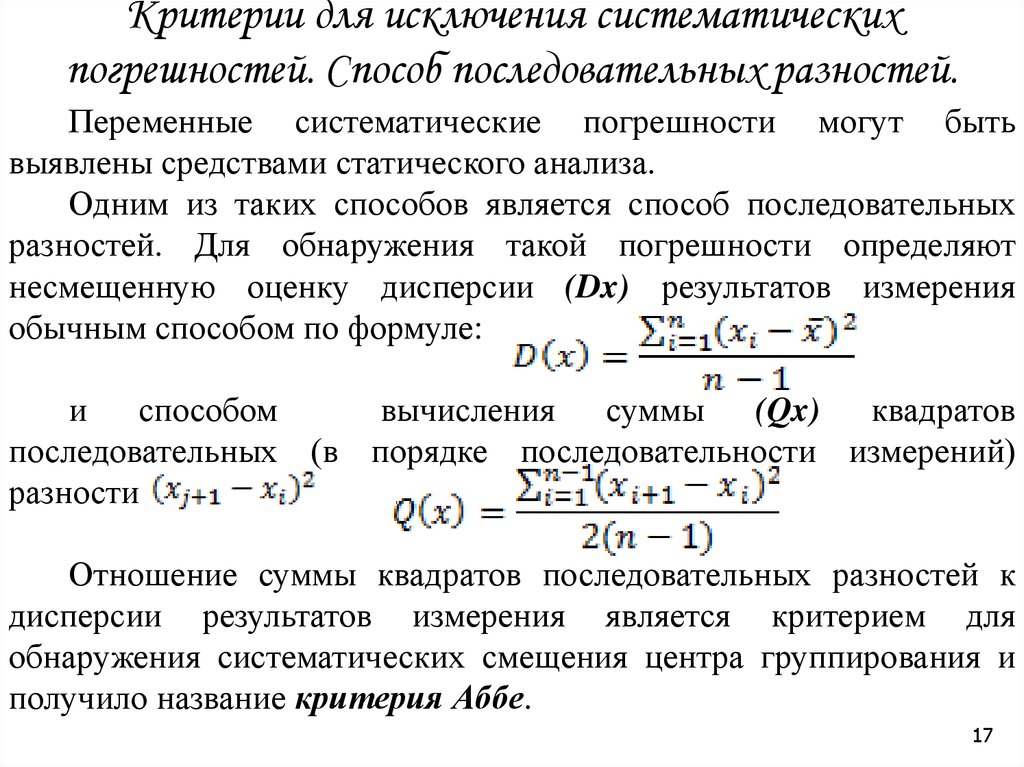

Выборочная дисперсия является смещенной оценкой генеральной дисперсии, поэтому в статистике применяют также исправленную выборочную дисперсию, которая является несмещенной оценкой генеральной дисперсии.

Сумма частот:

Вычислим среднюю:

Средняя квадратов:

Несмещенная выборочная дисперсия:

Ответ:

Кроме этой задачи на другой странице сайта есть пример расчета исправленной выборочной дисперсии и среднего квадратического отклонения для интервального вариационного ряда

2\) соответственно. Тогда возникает естественный вопрос, являются ли эти оценки «хорошими» в каком-либо смысле. Одним из показателей «хорошего» является «беспристрастность».

- Оценщик смещения и несмещения

Если выполняется следующее:

\(E[u(X_1,X_2,\ldots,X_n)]=\тета\)

, то статистика \(u(X_1,X_2,\ldots,X_n)\) является несмещенной оценкой параметра \(\theta\). В противном случае \(u(X_1,X_2,\ldots,X_n)\) равно 9np=\dfrac{1}{n}(np)=p\)

Первое равенство выполняется, потому что мы просто заменили \(\hat{p}\) его определением. Второе равенство выполняется по правилам математических ожиданий для линейной комбинации. Третье равенство выполняется, поскольку \(E(X_i)=p\). Четвертое равенство выполняется, потому что если вы сложите значение \(p\) до \(n\) раз, вы получите \(np\). И, конечно же, последнее равенство — это простая алгебра.

Таким образом, мы показали, что:

\(E(\hat{p})=p\)

Следовательно, оценка максимального правдоподобия является несмещенной оценкой \(p\). 9nE(X_i)=\dfrac{1}{n}\sum\limits_{i=1}\mu=\dfrac{1}{n}(n\mu)=\mu\)

Первое равенство выполняется, поскольку мы просто заменили \(\bar{X}\) его определением.

Опять же, второе равенство выполняется по правилам математических ожиданий для линейной комбинации. Третье равенство выполняется, поскольку \(E(X_i)=\mu\). Четвертое равенство выполняется, потому что если вы сложите значение \(\mu\) до \(n\) раз, вы получите \(n\mu\). И, конечно же, последнее равенство — это простая алгебра.

Опять же, второе равенство выполняется по правилам математических ожиданий для линейной комбинации. Третье равенство выполняется, поскольку \(E(X_i)=\mu\). Четвертое равенство выполняется, потому что если вы сложите значение \(\mu\) до \(n\) раз, вы получите \(n\mu\). И, конечно же, последнее равенство — это простая алгебра.Итак, мы показали, что: 92\), \(S\) равно

, а не , это несмещенная оценка \(\сигма\). (Вас также попросят показать это в домашнем задании.)Иногда невозможно найти оценки максимального правдоподобия в удобной закрытой форме. Вместо этого необходимо использовать численные методы для максимизации функции правдоподобия. В таких случаях мы могли бы рассмотреть возможность использования альтернативного метода нахождения оценок, такого как «метод моментов». Давайте посмотрим на этот метод сейчас.

Смещение и дисперсия в линейных моделях | by Nischal M

Взгляд на компромисс смещения и дисперсии для линейных моделей

Я уверен, что все видели эту диаграмму в прошлом:

«Понимание компромисса смещения и дисперсии» очень подробно описывает компромисс и ошибки, и я настоятельно рекомендую его.

Приведенный выше рисунок является первым рисунком в сообщении и показывает прогнозы нескольких моделей с разными ошибками смещения и дисперсии. Яблочко — это истинное значение, которое мы хотим предсказать, а синие точки — это то, что на самом деле предсказывает модель. В этом посте я хочу попытаться наглядно показать, как компромисс между смещением и дисперсией обретает форму в линейных моделях.

Приведенный выше рисунок является первым рисунком в сообщении и показывает прогнозы нескольких моделей с разными ошибками смещения и дисперсии. Яблочко — это истинное значение, которое мы хотим предсказать, а синие точки — это то, что на самом деле предсказывает модель. В этом посте я хочу попытаться наглядно показать, как компромисс между смещением и дисперсией обретает форму в линейных моделях.Почему линейные модели?

Потому что они хорошо понятны и дают очень простой способ контролировать эти ошибки — посредством регуляризации. Известно, что регрессия по методу наименьших квадратов (OLS) дает объективные результаты с низкой дисперсией по сравнению с нелинейными моделями. Ridge (OLS со штрафом L2) и Lasso (OLS со штрафом L1) дают необъективные результаты с гораздо меньшей дисперсией по сравнению с OLS. Степень штрафа контролируется коэффициентом регуляризации λ. Что, в свою очередь, контролирует две ошибки, как мы увидим ниже.

Лассо на самом деле является особым случаем из-за его агрессивного характера, сводящего оценки коэффициентов к нулю, но помогает сохранять объективность. Подробнее о регуляризации можно прочитать здесь.

Лассо на самом деле является особым случаем из-за его агрессивного характера, сводящего оценки коэффициентов к нулю, но помогает сохранять объективность. Подробнее о регуляризации можно прочитать здесь.Процедура

Я буду придерживаться того же метода, который использовался для концептуального описания ошибок в посте Скотта. Здесь я произвольно выбираю все фиксированные числа.

- Моделирование 500 точек данных из y = α+ βx + ϵ , где ϵ ~ N(0, 8), x ~ U(-2, 2), α = 2 и β = 3.

- Выполните первый шаг 1000 раз и соберите все наборы данных.

- Для каждого набора подогнать модели OLS, Ridge и Lasso с фиксированным λ, чтобы предсказать y для x = 3, Ожидаемый прогноз должен быть 2 + 3 x 3 = 11

Теперь у нас есть 3000 (1000 OLS + 1000 Ridge + 1000 Lasso) прогнозов, на которые мы можем взглянуть, чтобы увидеть истинную «природу» этих моделей. Вы можете найти весь код для этого на моей странице GitHub здесь.

Заметка о том, как читать графики. Я хочу, чтобы вы обратили внимание на две вещи:

1. Расстояние между истинным значением, показанным черной пунктирной линией, и средним предсказанным значением для модели, показанным пунктирной линией того же цвета. Это расстояние равно смещение (или смещение в квадрате) моделей. Большое отклонение от истинного значения (11) является большим смещением.

2. Ширина гистограмм дисперсия модели. Большая ширина — большая дисперсия.λ ~ 0

Начиная с очень маленького значения лямбда. Это эквивалентно отсутствию штрафа, поэтому мы ожидаем таких же результатов, как и в МНК для Риджа и Лассо.

Сюжет не преподносит сюрпризов. Все три распределения перекрываются со средними значениями, близкими к истинному значению. Обратите внимание, насколько разбросано распределение. Существует большая дисперсия в прогнозе в диапазоне от 9до 13.

λ = 0,01

С (очень) небольшим штрафом легко увидеть действие регуляризации.

Распределения сместились влево (видно по среднему). Небольшой перекос наблюдается у Риджа, а относительно больший у Лассо. Неясно, изменилась ли дисперсия.

Распределения сместились влево (видно по среднему). Небольшой перекос наблюдается у Риджа, а относительно больший у Лассо. Неясно, изменилась ли дисперсия.λ = 0,05

При λ = 0,05 Лассо уже слишком агрессивен со смещением в 3 единицы. Ридж достаточно близок, но похоже, что у него такая же дисперсия. Так что преимущества Ridge по этим данным пока нет.

λ = 0,1

Почти такой же результат, как и выше. Пока трудно заметить какие-либо изменения в дисперсии.

λ = 0,5

Более высокий штраф дает некоторые (разумно) удовлетворительные подсказки. Погрешность на хребте увеличилась почти на три единицы, но дисперсия меньше. Лассо очень настойчиво настаивал на оценке нулевого коэффициента для β, что привело к очень большому смещению результата, но имеет небольшую дисперсию.

λ = 1 — Хорошие результаты!

Здесь компромисс явно перешел на другую сторону. Дисперсия Ridge невелика за счет более высокого смещения.

λ = 5

Чтобы действительно довести дело до конца, вот очень большой штраф.

Дисперсия на хребте невелика за счет гораздо более высокого смещения. Вам, вероятно, никогда не понадобятся такие большие штрафы. Но факты ясны: меньшая дисперсия ценой большей предвзятости.

Дисперсия на хребте невелика за счет гораздо более высокого смещения. Вам, вероятно, никогда не понадобятся такие большие штрафы. Но факты ясны: меньшая дисперсия ценой большей предвзятости.Смещение и дисперсия для различных значений регуляризации

Повторение вышеизложенного для диапазона значений регуляризации дает ясную картину.

- Смещение вычисляется как расстояние от среднего прогноза и истинного значения — истинное значение минус среднее (прогнозы)

- Дисперсия — это среднее отклонение от среднего прогноза — среднее (прогноз минус среднее (прогнозы))

Графики дают одно и то же наблюдение. МНК имеет наименьшее смещение, но наибольшую дисперсию. Гребень выглядит как плавный сдвиг, а Лассо становится постоянным примерно после λ = 0,2 (β становится равным 0, таким образом предсказывая y = α для всех значений x ) .

Идеальные распределения

Лучший выбор данных может дать нам идеальный график выборочных распределений прогнозов.

Преимущество Ridge сразу становится очевидным из-за перекрывающихся распределений. Ridge дает слегка предвзятый прогноз, но гораздо чаще дает более точный прогноз, чем OLS. Это истинная ценность Риджа. Небольшой уклон, но более последовательные прогнозы. OLS дает беспристрастный результат, но не очень последователен. Это ключевой момент, МНК дает объективный результат

в среднем, не всегда . И это компромисс между смещением и дисперсией, принимающий форма в линейных моделях.Вы можете найти весь код, который я использовал для этого поста, здесь. Я рекомендую вам запустить его для разных значений λ, чтобы увидеть изменения для себя. Может быть, даже использовать его в другом наборе данных и посмотреть, сможете ли вы увидеть какое-то совпадение. Если у вас есть какие-либо предложения для этого поста, пожалуйста, не стесняйтесь обращаться и говорить привет.

Я просто хочу воспользоваться моментом, чтобы поблагодарить всех, кто сделал этот пост возможным.