Противоположные события – наиболее полная информация, все данные быстро и просто

Определение 1

Если существует такой набор попарно несовместных событий, что при проведении испытания обязательно наступает одно из этих событий, то подобный набор называется полной группой.

Теорема 1

Если сложить вероятности полной группы событий, то результат будет равен единице. То есть если есть события А1, А2, … Аn и они являются полной группой, то всегда будет выполняться следующее выражение:

Р(А1)+P(А2)+ … +Р(Аn)=1.

Доказательство:

Исходя из определения полной группы, вероятность наступления события принадлежащего к ней является достоверным. А значит мы можем сделать следующую запись:

Р(А1+А2+ … +Аn)=1. (1)

События в полной группе являются попарно несовместными, а значит можно использовать теорему сложения и тогда получим, что:

Р(А1+А2+ … +Аn)=Р(А1)+P(А2)+ … +Р(Аn). (2)

Сравнивая выражения (1) и (2) получим результат:

Р(А1)+P(А2)+ … +Р(Аn)=1.

Определение 2

Два явления, создающих совместно полную группу называют противоположные события. Они обозначаются как А и $\overline{A}$.

Пример 1

При стрельбе возникает две ситуации: попадание и промах. Эти события являются противоположными, потому что они взаимоисключающие и помимо них нет никакого третьего варианта развития ситуации

236

проверенных автора готовы помочь в написании работы любой сложности

Мы помогли уже 4 396 ученикам и студентам сдать работы от решения задач до дипломных на отлично! Узнай стоимость своей работы за 15 минут!

Пример 2

Предположим у нас есть ящик, в котором лежат шары двух цветов — белые и чёрные. При этом событие заключающееся в вытаскивании белого шара и событие заключающееся в вытаскивании чёрного шара являются противоположными. Они взаимно исключают друг друга и при этом полностью описывают все возможные ситуации в заданных условиях.

Пример 3

Предположим ситуацию — студент готовиться к экзамену. Тогда он заранее знает, что в день экзамена у него есть только две возможности: сдать экзамен или не сдать экзамен. Это и есть два противоположных события. В зависимости от качества его подготовки вероятность этих событий будет меняться. Конечно, готовиться лучше всего так, чтобы вероятность сдать экзамен была максимально большой.

Тогда он заранее знает, что в день экзамена у него есть только две возможности: сдать экзамен или не сдать экзамен. Это и есть два противоположных события. В зависимости от качества его подготовки вероятность этих событий будет меняться. Конечно, готовиться лучше всего так, чтобы вероятность сдать экзамен была максимально большой.

Теорема 1

Определить вероятность противоположного события можно как $Р(\overline{A})=1-Р(А)$.

Доказательство

Обозначим буквой m — всё количество элементарных результатов эксперимента, а буквой n — количество результатов, соответствующих событию А. Тогда для противоположного события $\overline{A}$ количество элементарных результатов, ему соответствующих, будет (m-n). Теперь запишем вероятность противоположного события через элементарные результаты:

$Р(\overline{A})= \frac{m-n}{m}=\frac{m}{m}-\frac{n}{m}=1-P(A)$

В результате получили искомое выражение.

Теорема 2

Если вероятности противоположны событий суммировать, то результирующая вероятность будет равна единице.

$Р(\overline{A})+P(A)=1$

Доказательство

Данную теорему легко вывести из теоремы предыдущей. Также верность теоремы следует из определения полной группы. Противоположные события как раз и являются таким набором, который образует полную группу. Как следует из теоремы о полной группе, сумма вероятностей событий входящих в полную группу равна единице. Отсюда можно сделать вывод, что сумма вероятностей противоположных событий тоже равна единице.

Появление понятия о противоположных событиях связано с удобством его применения во многих прикладных задачах. Часто встречаются ситуации, когда для упрощения требуется от основного события к противоположному. Приведём соответствующие примеры.

Пример 1

Допустим у нас есть игральный кубик и необходимо определить вероятность выпадения числа шесть, четыре, три, два и единица. Всего у кубика шесть граней и поэтому полная группа составляет шесть событий. Для удобства и простоты вычислений мы может рассчитать вовсе не вероятность выпадения всех указанных в услови числе, а вычислить вероятность только для одного, для числа пять. Это событие будет обратным по отношению к выпадению чисел от единицы до четвёрки и отдельно шестёрки. Для выпадения числе пять вероятность найти очень легко:

Это событие будет обратным по отношению к выпадению чисел от единицы до четвёрки и отдельно шестёрки. Для выпадения числе пять вероятность найти очень легко:

$Р(\overline{A})= \frac{1}{6}-$.

Зная уже эту величину окажется гораздо проще вычислить величину искомую, она будет:

$Р(А)=1-Р(\overline{A})= 1-\frac{1}{6}=\frac{5}{6}$

Пример 2

Рассмотрим другой, более сложный пример. Имеется два шестигранных игральных кубика. Необходимо вычислить вероятность, что при броске не выпадет число одиннадцать. Чтобы упростить решение задачи будем искать противоположное событие, а именно $\overline{A}$, которое заключается в том, что число одиннадцать выпадает.

Теперь представим сколько различных элементарных результатов соответствует данному событию $\overline{A}$. Анализ показывает, что таких события всего два: Анализ показывает, что таких события всего два: m=2. То есть если выпадает число 5 на первом кубике и число 6 на втором или наоборот выпадает число 6 на первом и число 5 на втором.

Вычислиv общее количество элементарных результатов, которые могут получиться в условиях заданных в задаче: $n=6\dot 6=36$

Теперь, имея все необходимые вводные, выразим вероятность противоположного события:

$P(\overline{A})=\frac{m}{n}=\frac{2}{36}=\frac{1}{18}$.

Теперь мы избавлены от необходимости перебирать все возможные результаты событий и можем перейти непосредственно к вычислению искомой вероятности используя теорему о вероятности противоположных событий:

$P(A)=1-P(\overline{A})=1-\frac{1}{18}=\frac{17}{18}$.

Итоговый результат: вероятность невыпадения числа одиннадцать как суммы цифр на двух кубиках будет равна 0,94.

Пример 3

Особенно удобно использовать обратную вероятность, если по истечении эксперимента можно получить очень много результатов. Так, если представить себе корзину, в которой находится сто шариков с номерами, то, например, вероятность того, что при изымании одно шарика из корзины нам не попадётся шестой было бы не просто вычислить, если бы не было введено понятие о противоположных событиях.

Теперь ясно, что взяв за основное событие А — шарик 6 не вынут, его противоположностью будет $\overline{A}$ — вынут шарик под номером шесть. Вероятность вынуть один шарик из ста составляет $\frac{1}{100}$. Тогда ответ на исходный вопрос — вероятность не вынуть один конкретный шарик составит:

$P(A)=1-P(\overline{A})=1-\frac{1}{100}=\frac{99}{100}$.

Основы теории вероятностей — Медицинская статистика (Медицина)

Основы теории вероятностей.

Теория вероятностей – это раздел математики, который изучает закономерности в массовых случайных событиях.

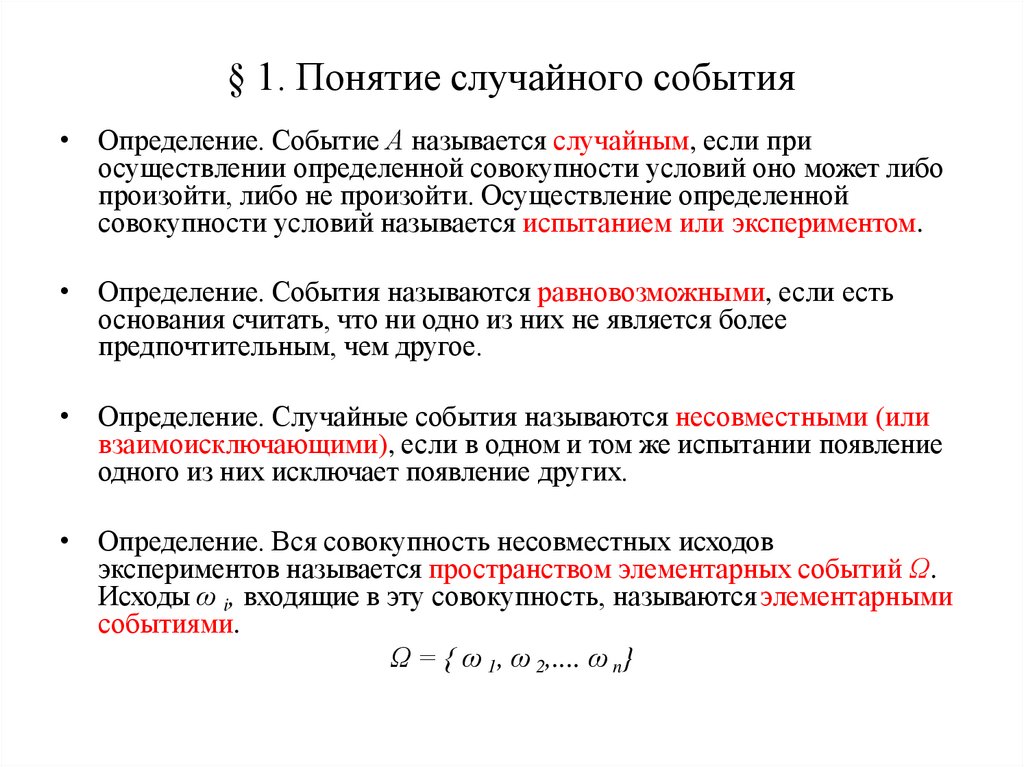

Событие – это факт, который может произойти или не произойти в результате проведения опыта или испытания.

Выделяют три вида событий:

а) достоверные

б) невозможные

с) случайные

Достоверное событие – это событие, которое обязательно произойдёт в результате данного опыта.( например: при бросании кубика выпадет 1≤целое число≤6).

Невозможное событие – это событие, которое никогда не произойдет в условиях данного опыта. .( например: при бросании кубика выпадет число≥7, например 10).

Случайное событие – это событие, которое может произойти или не произойти в результате данного опыта. ( например: бросили кубик один раз – выпадение числа 3 – случайное событие).

События обозначаются первыми заглавными буквами латинского алфавита: А, В, С, D,.

События называются массовыми, если они происходят одновременно в достаточно большом числе испытаний или многократно повторяются .( например: много людей бросают кубики или один человек бросает кубик много раз).

1. Классификация случайных событий.

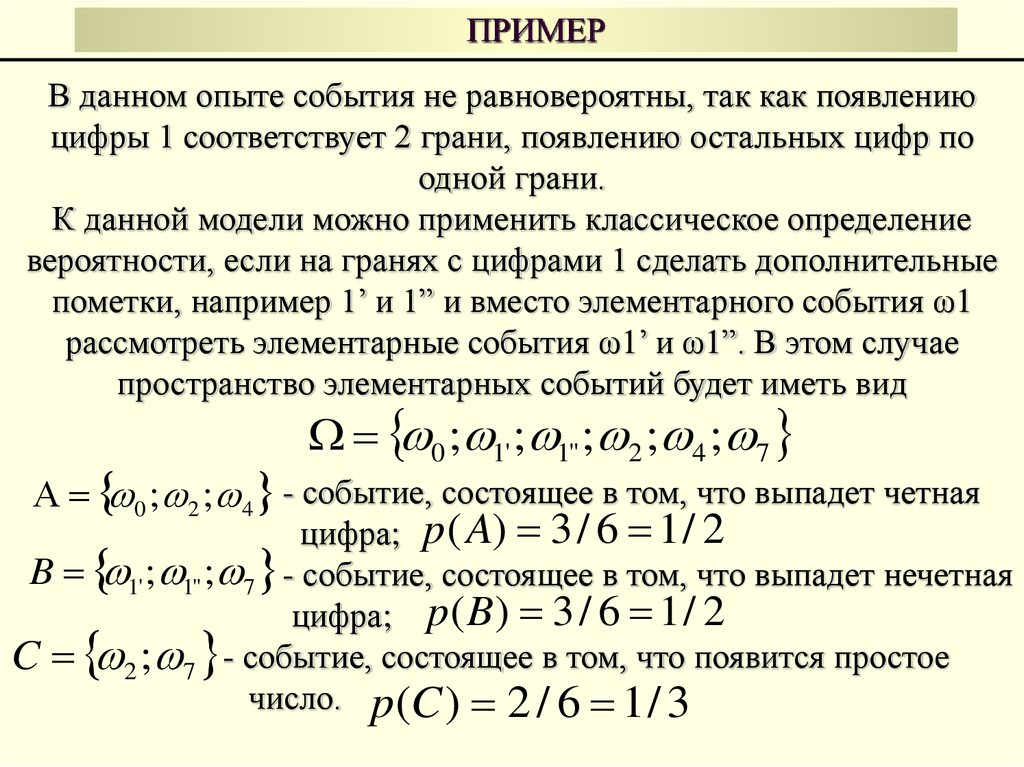

Равновозможные события – это события такие, что ни одно из них не является более возможным, чем другие ( например: кубику всё равно на какую грань упасть).

Совместные события – это события, которые могут произойти одновременно в результате данного опыта. ( например: бросаем 2 кубика — выпадение числа 1 и выпадение числа 3 – совместные события).

( например: бросаем 2 кубика — выпадение числа 1 и выпадение числа 3 – совместные события).

Несовместные события – это равновозможные события такие, что появление одного из них исключает появление остальных.( например: бросаем 1 кубик – выпадение цифры 3 исключает выпадение остальных цифр).

Несколько случайных событий: образуют полную группу событий, если каждое из них может произойти в результате данного опыта. ( например: выпадение чисел 1,2,3,4,5,6 –полная группа событий для бросания одного кубика).

Противоположные события – это равновозможные несовместные события, образующие полную группу событий. Появление события исключает появление события . ( например: орёл или решка, попадание в мишень или промах).

Несмотря на то, что события случайные, при большом числе опытов они подчиняются закономерностям, которые изучает теория вероятностей.

2 Вероятность случайного события.

Вероятность случайного события (обозначается Р(А)) –это число, которое говорит нам о степени возможности наступления события .

Существуют два определения вероятности: классическое и статистическое, каждое из них имеет свои достоинства и недостатки.

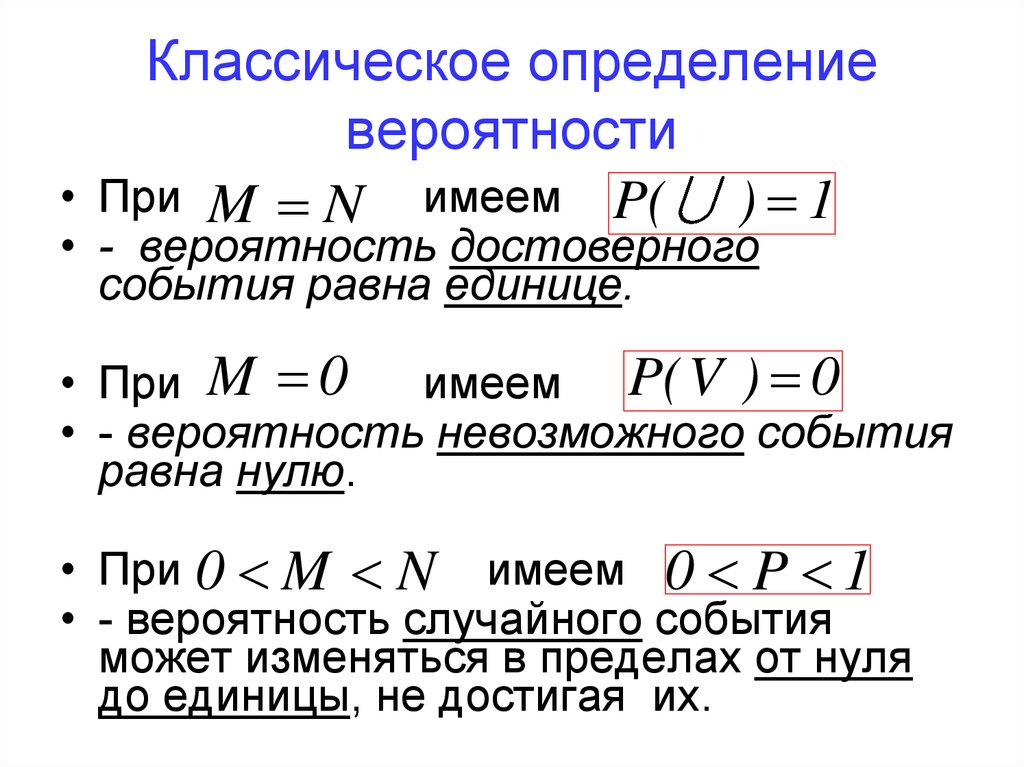

Классическое определение вероятности.

Вероятность события – это отношение числа исходов, благоприятствующих данному событию (m), к общему числу всех несовместных и равновозможных исходов данного опыта (n).

Если А – случайное событие, то

Если А – достоверное событие, то

Если А – невозможное событие, то

Пример: при бросании кубика возможно 6 исходов

Событие А: выпадет четное число. Число исходов, благоприятствующих событию А, m=3.

Достоинства: можно вычислить вероятность не производя испытания.

Недостатки: 1) не всегда известно число исходов опыта,

2) часто невозможно представить результат испытаний в виде равновозможных и несовместных событий.

Поэтому на практике часто пользуются статистическим определением вероятности.

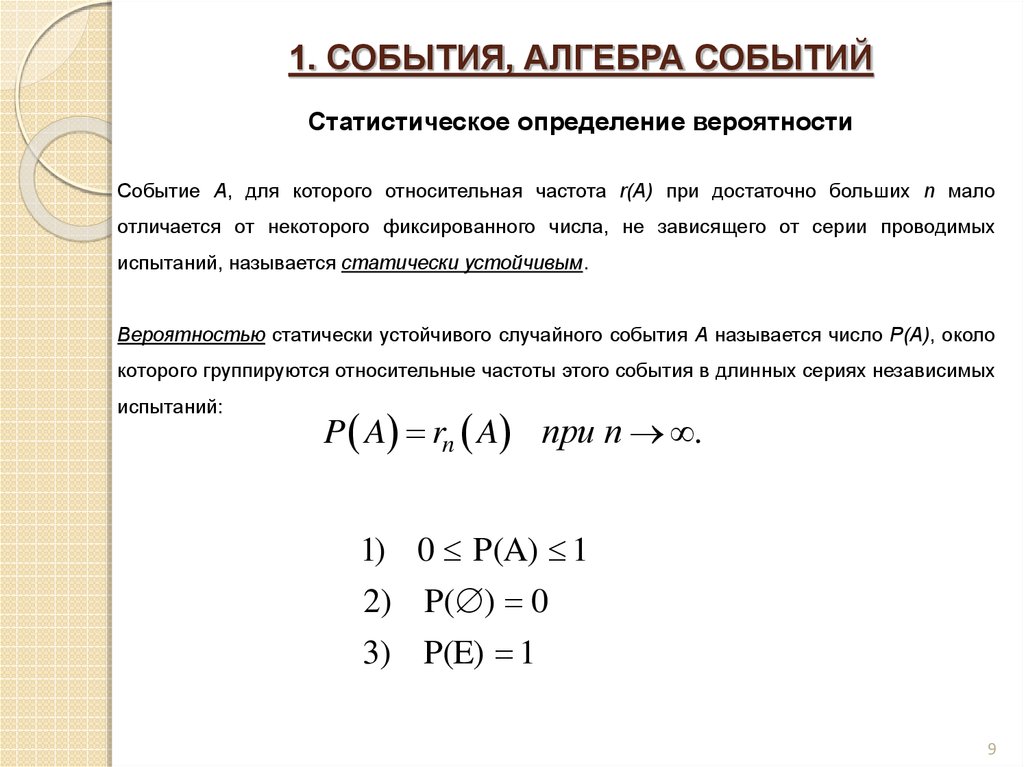

Статистическое определение вероятности.

Пусть А – случайное событие, опыт проводился n раз, в результате опыта событие А произошло m раз, тогда m— частота наступления события А, а величина называется относительной частотой события А.

Для разных n , могут заметно отличаться, но если проводим длинную серию опытов, т.е. , то к некоторому пределу.

Статистической вероятностью события А называется предел, к которому стремится его относительная частота , при неограниченном увеличении числа испытаний.

Пример: среди 1000 новорожденных 517 мальчиков. Найти относительную частоту рождения мальчиков. , тем не менее, известно, что

Найти относительную частоту рождения мальчиков. , тем не менее, известно, что

Так как вероятность – это число следовательно, с этими числами можно производить арифметические действия.

3. Теоремы сложения вероятностей.

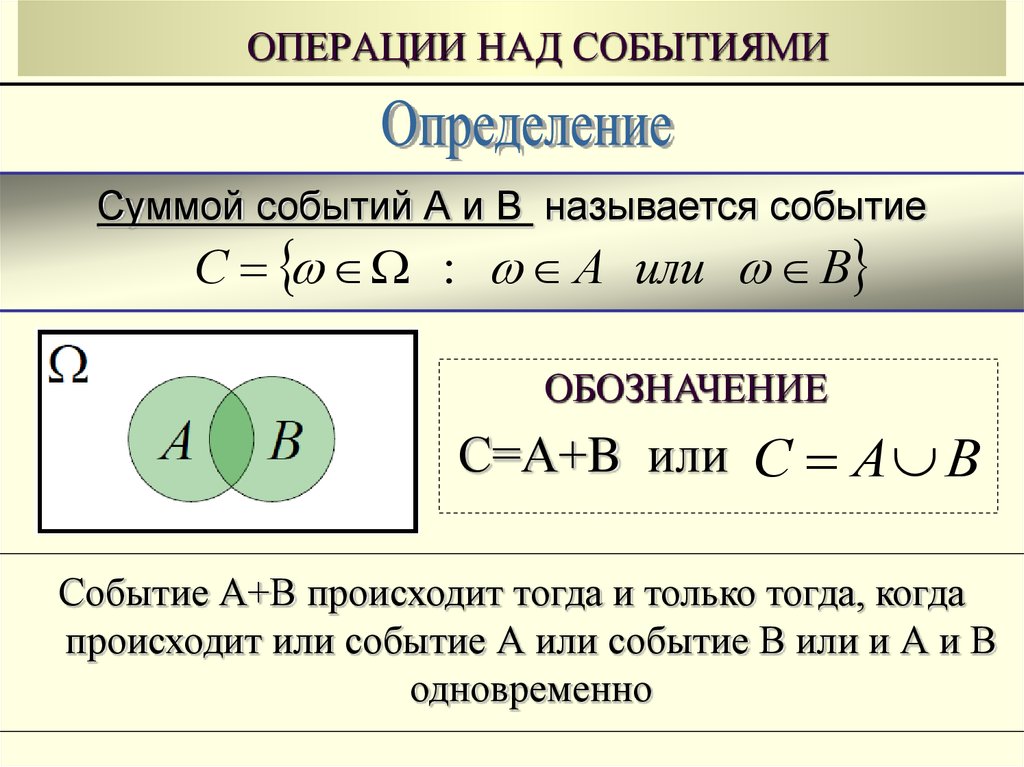

Суммой двух событий А+В называется событие, которое состоит в том, что произойдёт или событие А или событие В или оба они одновременно.

Суммой нескольких событий (А₁+А₂+А₃+…..+Аn) называется событие, которое состоит в том, что произойдёт хотя бы одно из этих событий.

Теорема 1: Вероятность двух несовместных событий равна сумме вероятностей этих событий:

Теорема 2: Вероятность суммы нескольких попарно несовместных событий равна сумме вероятностей этих событий:

Следствие 1:Сумма вероятностей событий, которые образуют полную группу, равна 1:

Следствие 2: Сумма вероятностей противоположных событий равна 1:

Теорема 3: Вероятность суммы двух совместных событий равна сумме вероятностей этих событий минус вероятность совместного их появления:

Пример: Бросаем 2 кубика: А – выпадет чётное число на первом кубике

В — выпадет чётное число на втором кубике

(А+В) – выпадет чётное число на первом или втором кубике или на первом и втором одновременно:

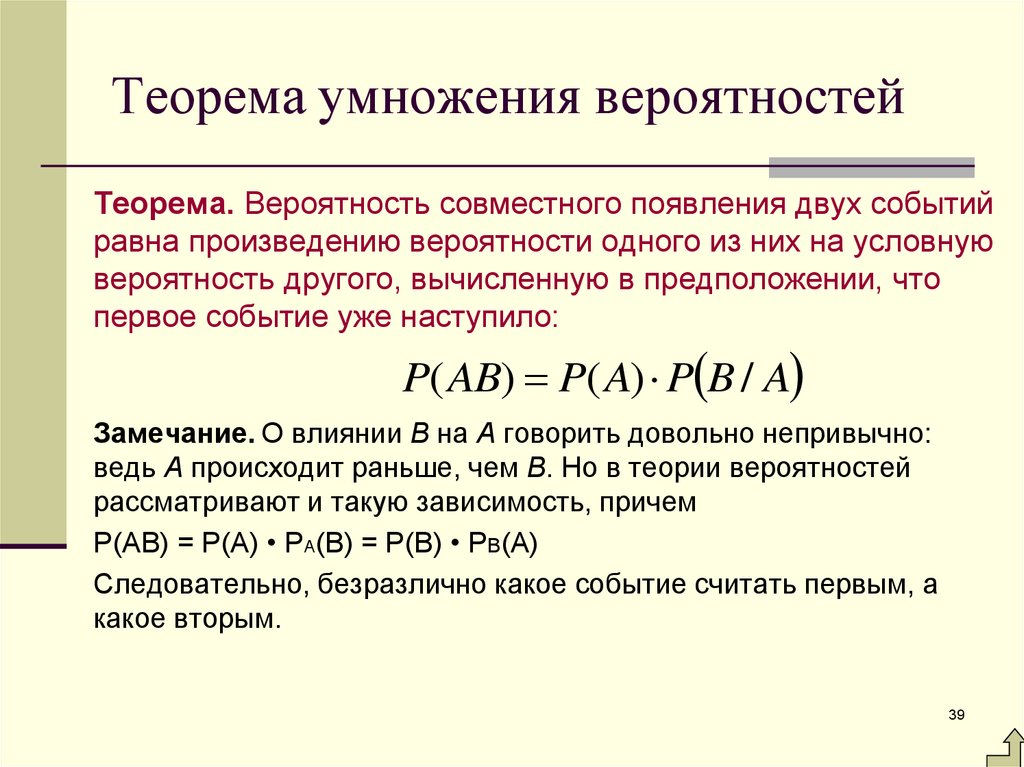

4. Теоремы умножения вероятностей.

Теоремы умножения вероятностей.

События бывают зависимыми и независимыми.

Событие В не зависит от события А, если Р(В) не изменяется от того, что произошло событие А.

Событие В зависит от события А, если Р(В) изменяется от того, что произошло событие А.

Р(В/А) – вероятность события В, при условии, что произошло событие А – это условная вероятность события В.

Произведением двух событий А·В , называется событие, которое состоит в том, что произойдёт и событие А и событие В.

Произведением нескольких событий А·В·С·D·… называется событие, которое состоит в том, что произойдут все эти события.

Теорема 1. Вероятность совместного появления двух независимых событий равна произведению их вероятностей.

Теорема 2. Вероятность совместного появления двух зависимых событий (В зависит от А) равна произведению вероятности события А на условную вероятность события В.

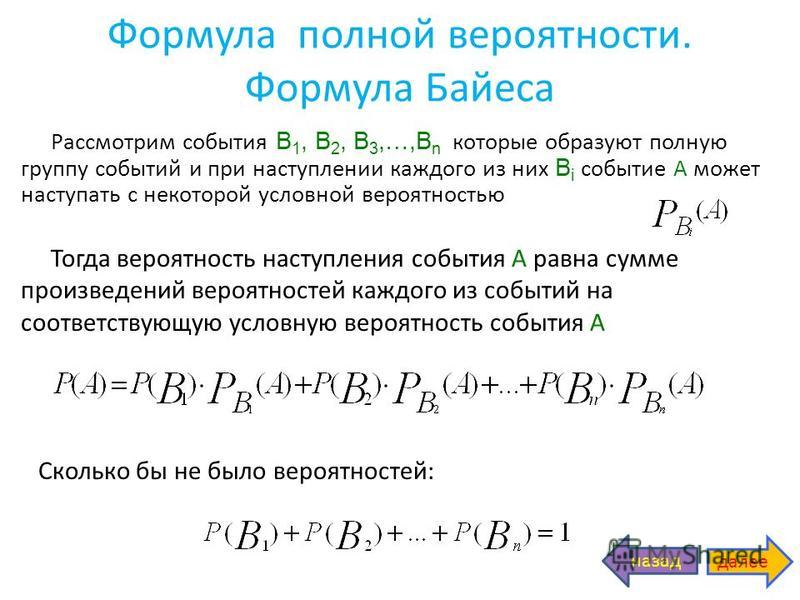

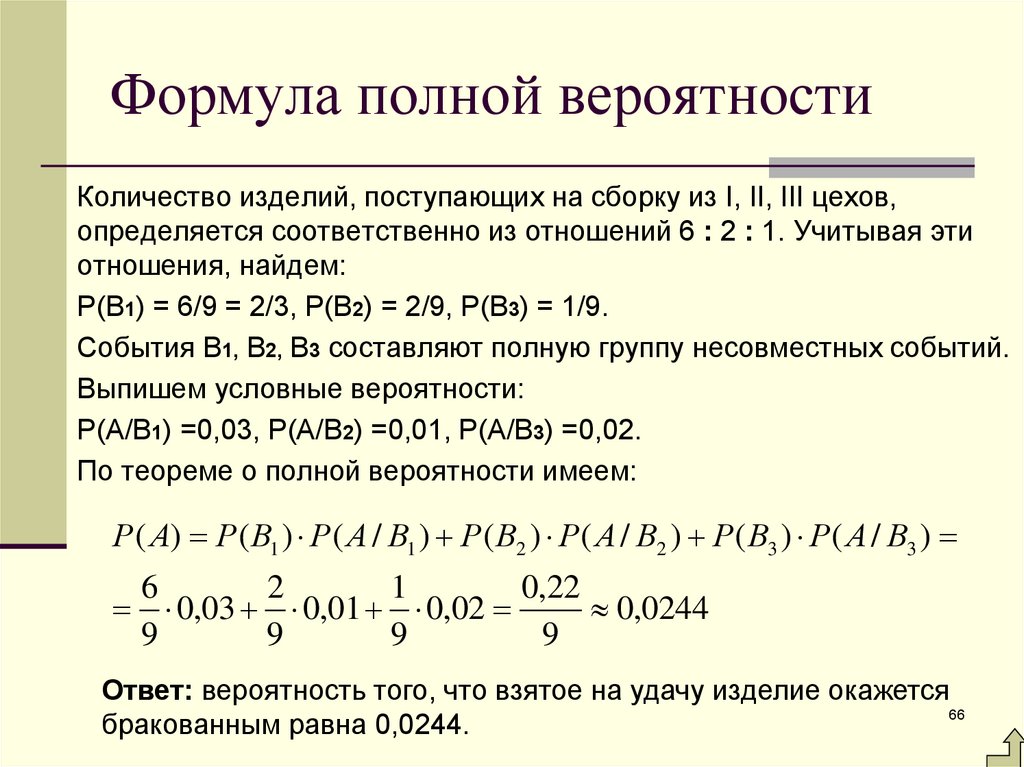

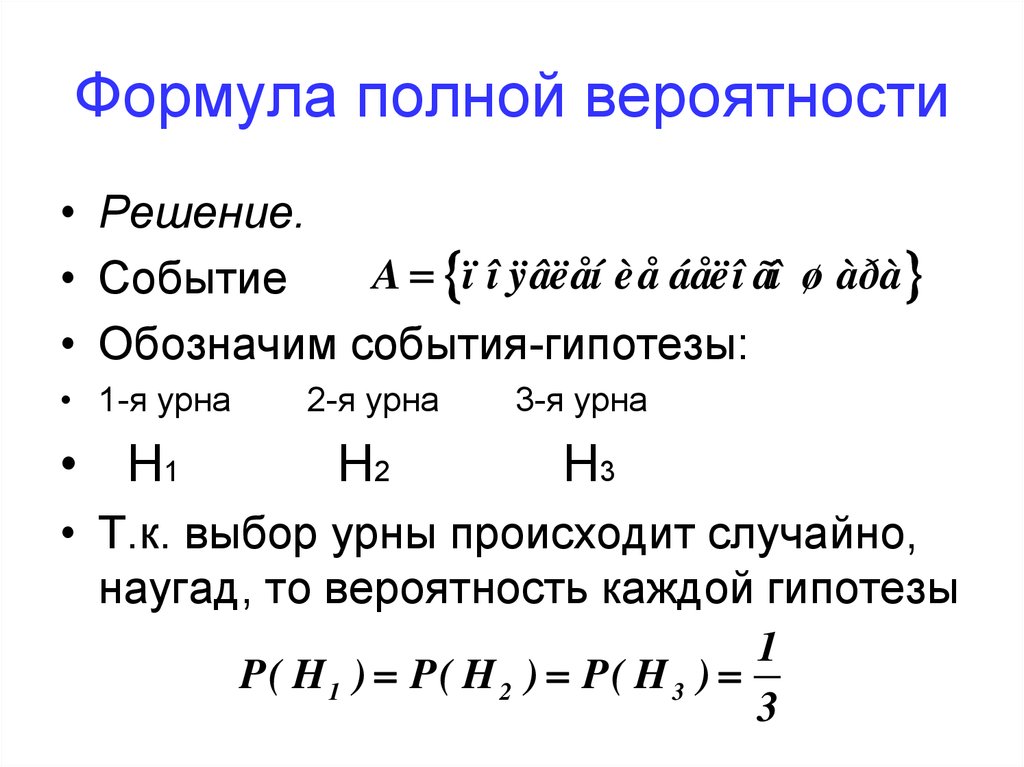

5. Формула полной вероятности.

Иногда событие А может произойти только совместно с одним из нескольких других событий, их принято называть гипотезами и обозначать Тогда полная вероятность события А вычисляется по формуле:

Пример: Н₃

Н₁ Н₂ СобытиеА:попадёмв домик.

6. Формулы Байеса.

Формулы Байеса.

До проведения опыта мы имели вероятности гипотез

(В примере ).

После проведения опыта:

Пусть событие А произошло (т.е. попали в домик), вероятности гипотез изменились. Для того, чтобы вычислить вероятности гипотез, при условии, что произошло событие А используют формулы Байеса:

Пример

7. Случайная величина.

Случайная величина – это переменная, которая принимает свои значения в зависимости от случайных обстоятельств.

.Дискретная случайная величина (точечная) принимает отдельные числовые значения (число студентов в аудитории, кубик: 1,2,3,4,5,6)

Непрерывная случайная величина принимает любые значения из некоторого интервала( масса тела, рост студентов).

Случайные величины обозначают заглавными последними буквами латинского алфавита:X,Y,Z…,а их возможные значения прописными буквами:

Любое правило, которое устанавливает связь между возможными значениями случайной величины и вероятностями, с которыми она эти значения принимает, называется законом распределения случайной величины.

Закон распределения случайной величины можно задавать в виде:

1).Таблицы

2). Графика

3) Функции распределения.

Дискретная случайная величина.

1).Таблица: Ряд распределения(может быть конечным или бесконечным)

Так как события X=x1, X=x2…. попарно несовместны и составляют полную группу событий, следовательно

2).График: многоугольник распределения.

3).Функция распределения F(x0)– это вероятность того, что случайная величина X принимает значения меньшие или равные x0.

Вероятность попадания значения случайной величины в заданный интервал:

Пример:

F(4)=P(X≤4)=Р(2)+Р(4)=0,1+0,2=0,3 F(8)=P(X≤8)=Р(2)+Р(4)+Р(6)+Р(8)=0,1+0,2+0,4+0,2=0,9

P(4<X≤8)=F(8)-F(4)=0,9-0,3=0,6

Непрерывная случайная величина.

1).Таблица: Интервальный ряд распределения.

Где к – количество интервалов.

2).График: Гистограмма.

3).Функция распределения.

4). Функция плотности распределения f(x): (только для непрерывной случайной величины).

Найдём предел:

Обозначим: . это функция плотности распределения.

То есть функция распределения F(x) является первообразной для функции плотности распределения f(x).

1). f(x) неотрицательная функция (f(x)≥0).

2). Вероятность попадания в элементарный интервал dx=(x+Δx)-x равна f(x)dx=dP.

3).Вероятность попадания случайной величины в интервал [a,b]:

4). Условие нормировки: площадь под кривой равна единице.

8. Числовые характеристики (параметры) случайной величины.

1). Математическое ожидание. Это среднее значение случайной величины.

Дискретная случайная величина.

.

Пусть проведено n испытаний,

случайная величина приняла значение

x1 — m1 — раз,

x2 — m2 — раз,

…………………..

Xk — mk — раз,где

К — количество различных значений,

mi — частота значения xi.

m1+m2+…+mk=n

Среднее арифметическое :

Непрерывная случайная величина.

2). Дисперсия (рассеивание). Это математическое ожидание (среднее значение) квадрата отклонения случайной величины X от её математического ожидания.

Дисперсия (рассеивание). Это математическое ожидание (среднее значение) квадрата отклонения случайной величины X от её математического ожидания.

Дискретная случайная величина.

Для вычисления дисперсии удобно пользоваться формулой:

Если X и Y независимые случайные величины,то

Непрерывная случайная величина.

Размерность дисперсии (единица измерения)2,поэтому используют:

3). Средне -квадратическое или стандартное отклонение.

Контрольные вопросы.

1. Предмет теории вероятностей.

2. Классификация случайных событий.

3. Теоремы сложения вероятностей.

Ещё посмотрите лекцию «Маркетинговыеые исследования в рекламе» по этой теме.

4. Теоремы умножения вероятностей.

5. Формула полной вероятности.

6. Формулы Байеса.

7. Дискретные и непрерывные случайные величины.

Дискретные и непрерывные случайные величины.

8. Способы задания закона распределения случайной величины.

9. Параметры распределения случайной величины.

Введение в теорию вероятностей

| Надежность HotWire | Выпуск 25, март 2003 г. | ||

| Горячие темы | |||

BlockSim 6 теперь доступен для обеспечения надежности системы,

ремонтопригодность, доступность, оптимизация, анализ пропускной способности и

гораздо более. В прошлых выпусках HotWire и Надежность Edge , много тем, касающихся системы

обсуждалась надежность, в том числе

конфигурация k из n и

распределение и оптимизация. В прошлом месяце

выпуск HotWire, тема несовершенного ремонта была

представлены. Терминология

Пример эксперимента по теории вероятностей Рассмотрим эксперимент, заключающийся в прокатке шестигранного игрального кубика. Цифры на каждой стороне кубика — это возможные исходы. Соответственно, выборочное пространство S = {1, 2, 3, 4, 5, 6}. Пусть А будет событием выпадение 3, 4 или 6 (A = {3, 4, 6}), а B — событие выпадения 2, 3 или 5 (В = {2, 3, 5}).

Вероятностные свойства, теоремы и аксиомы Вероятность события A выражается как P(A) и имеет следующие свойства: Другими словами, когда событие обязательно произойдет, его вероятность равна 1, и когда оно произойти невозможно, вероятность этого равна 0. Можно показать что вероятность объединения двух событий А и В равна: Аналогично, вероятность объединения трех событий, A, B и C, определяется как: Взаимоисключающие события Два события А и В называются взаимоисключающими, если они одновременное их появление невозможно ( А Б «=» В таких случаях выражение объединения этих двух событий сводится к до: , так как вероятность

пересечения этих событий определяется как ноль. Условная вероятность Условная вероятность двух событий А и В определяется как Вероятность того, что одно из событий произойдет, зная, что другое событие уже произошло. Выражение ниже обозначает вероятность A происходит при условии, что B уже произошло.

Обратите внимание, что зная, что событие B уменьшает пространство выборки. Независимые мероприятия Если знание B не дает информации об A, то говорят, что события быть независимым, и выражение условной вероятности сводится к: Из определения условная вероятность, уравнение (1) можно записать как: С момента событий А и Б независимы, выражение сводится к: Если группа из n событий, A i , независимы, тогда: В качестве иллюстрации,

рассмотрите результат броска шестигранной кости. Статистический фон Пример 1 Рассмотрим следующую систему, в которой два шарнирных элемента удерживают загрузить на место. Система выходит из строя, если любой из элементов выходит из строя, и нагрузка перемещается со своего места.

Отказ происходит, если Компонент 1 или компонент 2 или оба не работают. Системная вероятность сбой (или ненадежность): Обретение независимости (или что отказ любого компонента не зависит от успех или отказ другого компонента), системная вероятность неудача становится суммой вероятностей возникновения А и В минус произведение вероятностей: Другой подход заключается в рассчитать вероятность безотказной работы системы или надежность системы: Тогда вероятность сбоя системы — это просто 1 (или 100%) минус надежность: Статистический фон Пример 2 Рассмотрим следующую систему груза, удерживаемого на месте двумя жесткими члены:

Вероятность системы сбоя определяется как пересечение событий A и B: Обретение независимости ( т.е. любой из элементов достаточно прочен, чтобы удерживать нагрузку в место), вероятность отказа системы становится произведением вероятности отказа A и B: Надежность система теперь становится: | |||

Copyright 2003 Корпорация ReliaSoft, ВСЕ ПРАВА ЗАРЕЗЕРВИРОВАН | |||

Вероятность | Аксиомы | Шанс

← предыдущее

следующее →

Мы присваиваем вероятность меру $P(A)$ событию $A$.

Аксиомы вероятности:

- Аксиома 1: Для любого события $A$, $P(A) \geq 0$.

- Аксиома 2: Вероятность выборочного пространства $S$ равна $P(S)=1$.

- Аксиома 3: Если $A_1, A_2, A_3, \cdots$ — непересекающиеся события, то $P(A_1 \cup A_2 \cup A_3 \cdots)=P(A_1)+P(A_2)+P(A_3)+\cdots$

Давайте уделим несколько минут и убедимся, что мы полностью поняли каждую аксиому. Первая аксиома гласит

эта вероятность не может быть отрицательной. Наименьшее значение для $P(A)$ равно нулю, и если $P(A)=0$, то

событие $A$ никогда не произойдет.

Третья аксиома, наверное, самая интересная. Основная идея состоит в том, что если некоторые события не пересекаются (т. е. между ними нет пересечения), то вероятность их объединения должна быть суммой их вероятностей. Другой способ подумать об этом — представить вероятность множества как площадь этого множества на диаграмме Венна. Если несколько наборов не пересекаются, например, показанные Рис. 1.9, то общая площадь их объединения равна сумме площадей отдельных. Следующий пример иллюстрирует идею третьей аксиомы.

Пример

На президентских выборах есть четыре кандидата. Назовите их A, B, C и D. На основании нашего опроса

анализ, мы оцениваем, что A имеет 20-процентный шанс победить на выборах, в то время как B имеет 40-процентный шанс победить на выборах.

шанс на победу. Какова вероятность того, что A или B выиграют выборы?

Назовите их A, B, C и D. На основании нашего опроса

анализ, мы оцениваем, что A имеет 20-процентный шанс победить на выборах, в то время как B имеет 40-процентный шанс победить на выборах.

шанс на победу. Какова вероятность того, что A или B выиграют выборы?

Таким образом, если события $A_1$ и $A_2$ не пересекаются, то $P(A_1 \cup A_2)=P(A_1)+P(A_2)$. Тот же аргумент верно, когда у вас есть $n$ непересекающихся событий $A_1, A_2,\cdots,A_n$: $$P(A_1 \cup A_2 \cup A_3 \cdots\cup A_n)=P(A_1)+P(A_2)+\cdots+P(A_n), \textrm{ if } A_1, A_2,\cdots, A_n \textrm{ не пересекаются.}$$ На самом деле третья аксиома идет дальше этого и утверждает, что то же самое верно даже для счетно бесконечного числа. количество непересекающихся событий. Вскоре мы увидим больше примеров того, как мы используем третью аксиому.

Как мы видели, при работе с событиями пересечение означает » и» , а объединение означает » или».

Вероятность пересечения $A$ и $B$, $P(A\cap B)$, иногда обозначается как $P(A,B)$ или $P(AB)$.

Но каковы некоторые из основных понятий, лежащих в основе

блоки системной надежности и теории вероятностей? Эта статья будет

представить введение в эти понятия.

Но каковы некоторые из основных понятий, лежащих в основе

блоки системной надежности и теории вероятностей? Эта статья будет

представить введение в эти понятия.

Вероятность

прокат 3 — это один из шести или P (O = 3) = 1/6 = 0,16667. Все

последующие броски костей являются независимыми событиями, так как зная

результат первого броска костей не дает никакой информации о результате

последующие броски костей (если кости не загружены). Таким образом

Вероятность выпадения 3 при втором броске костей снова равна P(O = 3) =

1/6 = 0,16667. Однако если спросить, какова вероятность

бросив двойную тройку двумя костями, результат будет = 0,027778 (или

1/36).

Вероятность

прокат 3 — это один из шести или P (O = 3) = 1/6 = 0,16667. Все

последующие броски костей являются независимыми событиями, так как зная

результат первого броска костей не дает никакой информации о результате

последующие броски костей (если кости не загружены). Таким образом

Вероятность выпадения 3 при втором броске костей снова равна P(O = 3) =

1/6 = 0,16667. Однако если спросить, какова вероятность

бросив двойную тройку двумя костями, результат будет = 0,027778 (или

1/36).